Visoric beim Festival der Zukunft 2025 im Deutschen Museum

Foto: XR Stager News Room / Ulrich Buckenlei

Reality Check mit dem Robo Dog – Mensch, Maschine und Mixed Reality im Praxistest

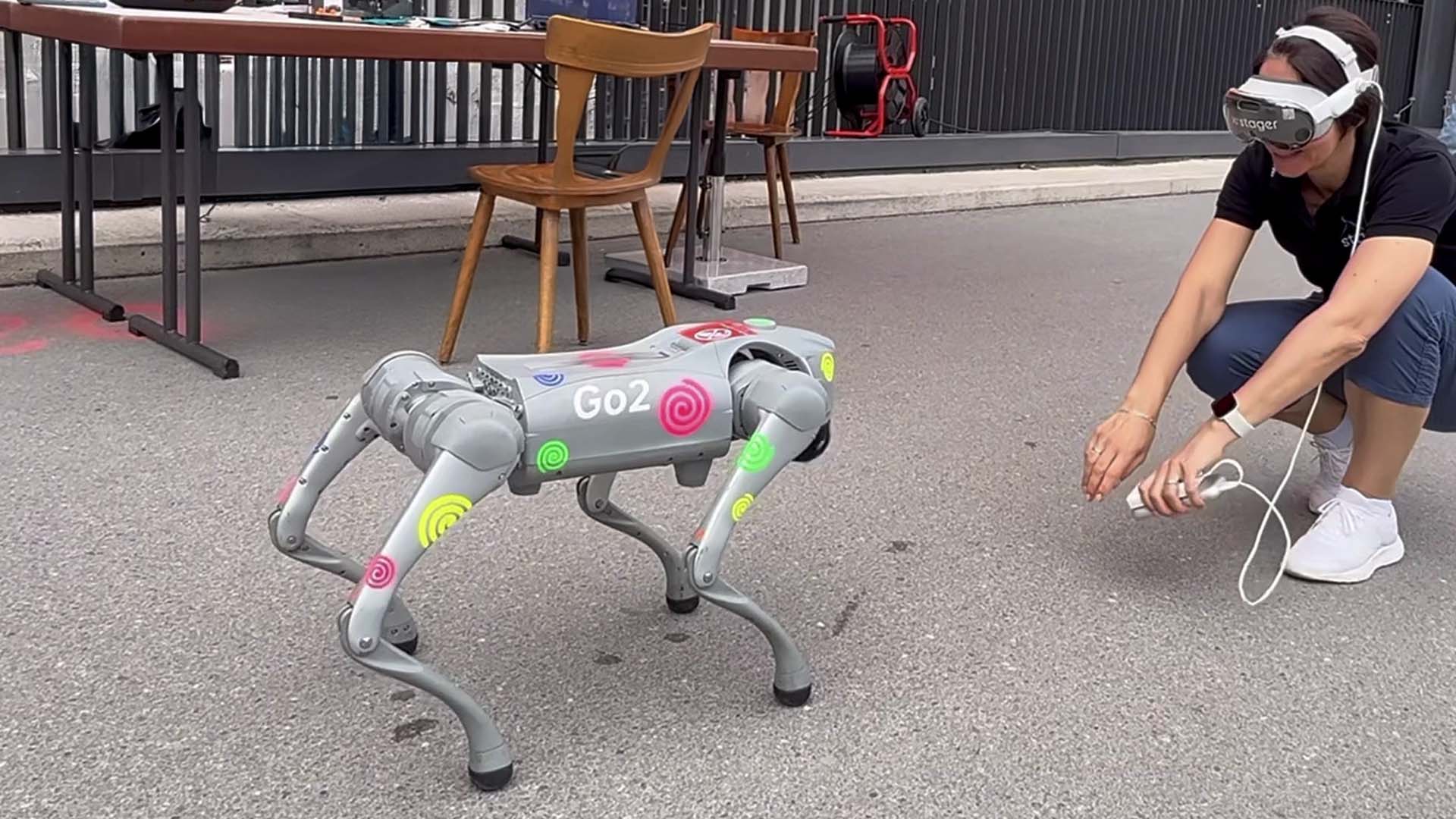

Wie real ist die Vision von intelligenter Mensch-Maschine-Interaktion mit Hilfe von XR-Headsets und autonomen Robotern? Beim Festival der Zukunft im Deutschen Museum München wurde diese Frage greifbar – und zwar buchstäblich. Das Visoric Team präsentierte in Zusammenarbeit mit Nataliya Daniltseva ein öffentliches Testsetup, das reale Robotik mit immersiver Technologie verknüpfte. Mit einem Apple Vision Pro auf dem Kopf und einem Roboterhund der Firma Unitree vor sich entstand eine Szene, die wie ein Blick in die Zukunft wirkte – obwohl sie technologisch noch nicht vollständig verknüpft war.

Gerade diese Lücke war Teil des Experiments: Was wäre, wenn? Wenn XR, KI und Robotik tatsächlich in Echtzeit kommunizieren? Der Showcase zeigte eindrucksvoll, wie nahe wir dieser Realität schon sind – und welche nächsten Schritte folgen müssen, damit aus einem Reality Check ein tatsächlicher Technologiedurchbruch wird.

Interaktion mit Roboterhund und Apple Vision Pro

Foto: XR Stager News Room / Ulrich Buckenlei

Gestensteuerung trifft Realität – Wie intuitive Kontrolle neu gedacht wird

Im Zentrum des Experiments stand die Frage nach der zukünftigen Steuerung autonomer Systeme. Die Testperson bewegte ihre Hände vor dem Roboter – der Roboter reagierte scheinbar auf die Gesten. Doch in Wahrheit war keine direkte Verbindung zwischen Gerät und Hund vorhanden. Diese inszenierte Lücke öffnete einen faszinierenden Diskurs: Wie kann man XR-Technologie wie die Apple Vision Pro mit Robotersteuerung intelligent verknüpfen?

- XR-Headset mit 3D-Mapping: Raum, Handbewegungen und Blickrichtung werden präzise erfasst

- Roboter mit Echtzeitsensorik: Autonomes Verhalten über WLAN, KI und ROS-Module steuerbar

- Verbindung denkbar: Eine Schnittstelle, viele neue Anwendungsmöglichkeiten

Die Besucher:innen erlebten hautnah, wie stark die Systeme bereits einzeln sind – und wie viel Potenzial in ihrer Verknüpfung liegt. Für viele war das Setup weniger eine Demonstration, als vielmehr eine Einladung zum Weiterdenken.

Der Unitree Go2 in Nahaufnahme

Foto: XR Stager News Room / Ulrich Buckenlei

Von Spiel zu Simulation – Lernprozesse durch immersive Robotik

Was auf den ersten Blick wie ein Experimentierfeld für Tech-Enthusiasten wirkte, hatte auch eine ernsthafte didaktische Dimension. Die Kombination aus XR-Brille und Robotik erlaubt Szenarien, in denen Lerninhalte physisch erfahrbar werden. Gesten werden zu Kommandos, Blickrichtungen zu Steuerbefehlen, Bewegungen zu Trainingsdaten.

- Berufliche Aus- und Weiterbildung: Simulation von Maschinenbedienung ohne physisches Risiko

- Industrielle Trainingsumgebungen: Intuitives Zusammenspiel zwischen Mensch und Maschine

- Forschung und Lehre: Datenbasiertes Feedback aus realer Interaktion

Gerade für komplexe Systeme, wie sie in Logistik, Produktion oder autonomen Flotten vorkommen, eröffnen sich durch diese Kombination völlig neue Wege der Mensch-Roboter-Kollaboration.

Visoric Testszene mit XR und Unitree

Foto: XR Stager News Room / Ulrich Buckenlei

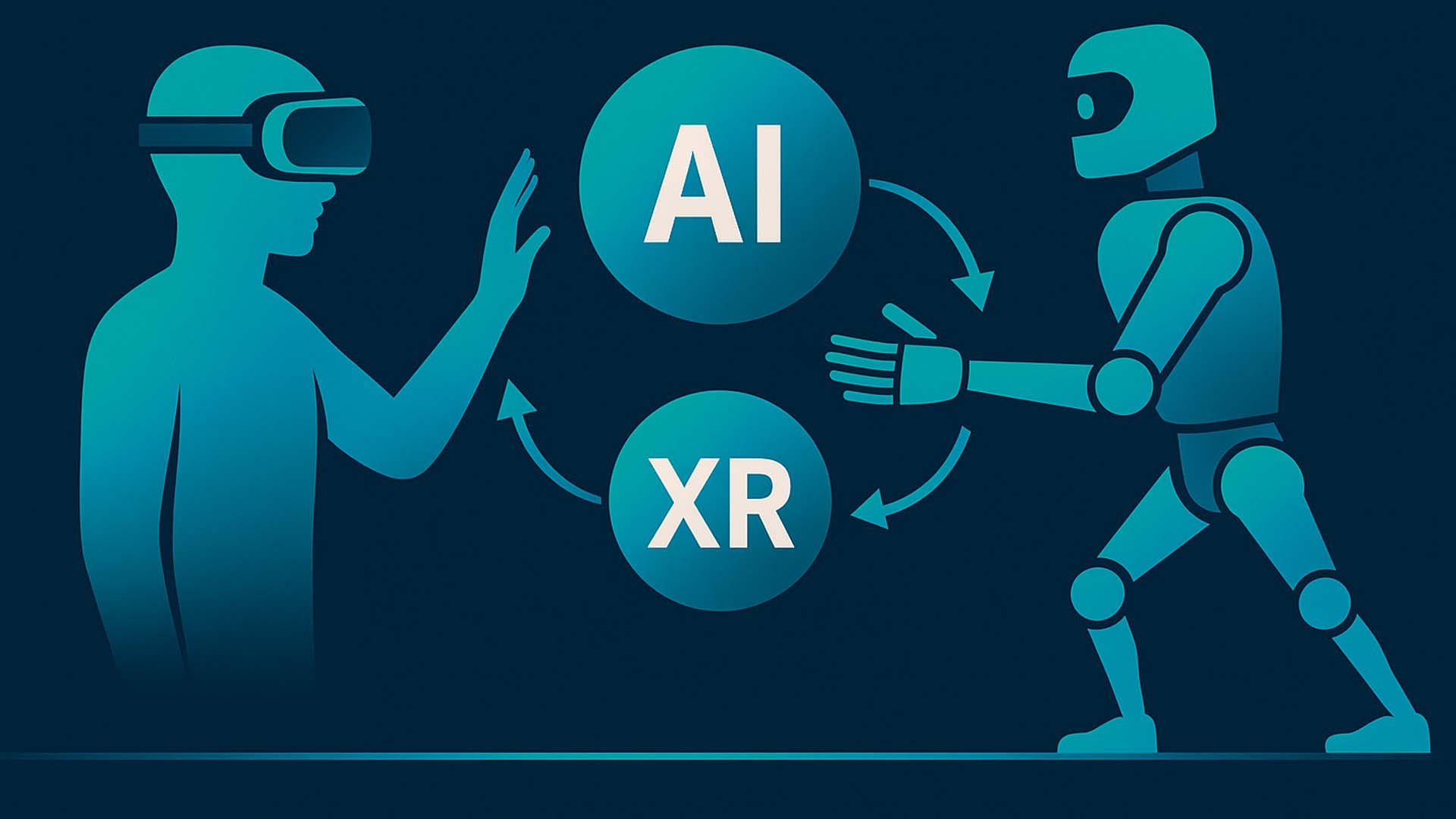

Technische Integration – wo Vision Pro und Robotik sich begegnen

Auch wenn im gezeigten Experiment noch keine direkte Kopplung zwischen Apple Vision Pro und dem Unitree-Roboter stattfand, ist die technologische Basis längst vorhanden. Die Brille erkennt Hände, Augen, Raumtiefe. Der Roboter versteht WiFi-Kommandos, verwendet neuronale Netze und lässt sich mit ROS koppeln. Eine vollständige Integration ist nicht nur möglich, sondern wahrscheinlich.

- Technologische Synergie: XR erfasst den Raum, Robotik agiert darin

- Gemeinsame Datenbasis: Sensordaten und Positionsdaten können verknüpft werden

- Vorausschauende Systeme: Der Roboter lernt, menschliche Intentionen zu interpretieren

Diese Perspektive eröffnet neue Horizonte – nicht nur für Entwickler:innen, sondern auch für Unternehmen, die künftig auf adaptive Automatisierung setzen wollen.

Das Visoric Experten Team in 3D, AI XR and Robotics

Visualisierung: XR Stager News Room / Ulrich Buckenlei

Immersive Robotik in der Industrie – eine neue Schnittstelle

Wenn KI, Raumverständnis und Roboterverhalten zusammenfließen, entsteht mehr als ein Assistenzsystem: Es entsteht ein adaptiver Partner, der kontextsensitiv handelt. Gerade in der Fertigung, Logistik oder Ausbildung werden Systeme benötigt, die nicht nur Befehle ausführen, sondern auch mitdenken.

- Vorausschauende Wartung: Roboter erkennen Zustände und reagieren dynamisch

- Kooperation statt Steuerung: Menschliche Geste wird zur gemeinsamen Sprache

- Neue UX für Maschinen: XR wird zum Interface für robotische Systeme

Diese neue Schnittstelle – zwischen Maschine und Mensch – wird die Art, wie wir Technik erleben, grundlegend verändern. Und sie beginnt mit dem ersten Prototypen, dem ersten Test, der ersten Frage: Was wäre wenn?

Interaktive Mensch-Maschine-Koordination

Foto: XR Stager News Room / Ulrich Buckenlei

Video: Robo Dog trifft XR – Eine Szene mit Symbolkraft

Eine Szene wie aus der Zukunft: XR-Headset, Gesten, ein robotischer Hund – und ein Gedanke, der bleibt. Die Interaktion mag noch simuliert sein, doch sie steht exemplarisch für eine technologische Realität, die bald kommen könnte.

by Visoric XR Studio | Reality Check mit Vision Pro und Roboterhund

Video: © Visoric GmbH | 1E9 & Festival der Zukunft, Deutsches Museum München

Kontaktieren Sie unser Experten-Team

Das Visoric Team unterstützt Unternehmen bei der Entwicklung und Umsetzung intelligenter XR- und Robotiklösungen – von der Prototypentwicklung bis zur Anwendung in der Industrie.

- XR-Schnittstellen für Robotik: Mixed Reality trifft auf Echtzeitsteuerung

- Adaptive Trainingslösungen: Immersive Szenarien für Mensch-Maschine-Interaktion

- Beratung & Entwicklung: Von der Idee bis zum realen Produkt – gemeinsam mit Ihnen

Jetzt Kontakt aufnehmen – und gemeinsam die Zukunft der Interaktion gestalten.

Kontaktpersonen:

Ulrich Buckenlei (Kreativdirektor)

Mobil: +49 152 53532871

E-Mail: ulrich.buckenlei@visoric.com

Nataliya Daniltseva (Projektleiterin)

Mobil: + 49 176 72805705

E-Mail: nataliya.daniltseva@visoric.com

Adresse:

VISORIC GmbH

Bayerstraße 13

D-80335 München