Wenn Realität zur digitalen Grundlage wird

Redaktionelles Bild | Motiv: Ulrich Buckenlei erfasst reale Umgebung mit Smartphone für 3D-Rekonstruktion | Kontext: Analyse moderner Reality-Capture-Verfahren zwischen Photogrammetrie, LiDAR und AI-basierter Verarbeitung | Quelle: © Ulrich Buckenlei | Visoric GmbH

Die digitale Abbildung der Realität war lange ein komplexer, technischer Prozess. Hochpräzise 3D-Modelle entstanden entweder durch aufwendige Laserscans oder durch Photogrammetrie, bei der aus hunderten Bildern dreidimensionale Strukturen rekonstruiert werden. Beide Verfahren lieferten brauchbare Ergebnisse, waren jedoch in Aufwand, Kosten und Verarbeitung limitiert.

LiDAR-Systeme ermöglichen eine direkte geometrische Erfassung von Umgebungen mit hoher Genauigkeit. Sie sind unabhängig von Lichtverhältnissen und liefern stabile Daten, stoßen jedoch bei feinen Oberflächenstrukturen oder Materialien schnell an Grenzen. Gleichzeitig sind sie oft kostenintensiv und in der Anwendung weniger flexibel. [9][11]

Photogrammetrie verfolgt einen anderen Ansatz. Hier entstehen 3D-Modelle aus Bilddaten, wodurch visuelle Details deutlich realistischer dargestellt werden können. Der Nachteil liegt jedoch in der Abhängigkeit von Licht, Perspektive und Bildqualität sowie in der vergleichsweise aufwendigen Nachbearbeitung. [10][12]

Über Jahre hinweg bedeutete das eine klare Entscheidung. Entweder Präzision durch Sensorik oder visuelle Qualität durch Bildverarbeitung. Beide Welten waren getrennt.

Genau an diesem Punkt beginnt ein grundlegender Wandel.

Mit neuen Verfahren wie Gaussian Splatting verschiebt sich die Rolle der Datenerfassung. Statt komplexer Modellierung steht die direkte Nutzung realer Bilddaten im Fokus. Realität wird nicht mehr abstrahiert, sondern unmittelbar in eine nutzbare digitale Form überführt. [1]

Die entscheidende Veränderung liegt dabei nicht nur in der Qualität, sondern in der Geschwindigkeit. Was früher Stunden oder Tage an Verarbeitung benötigte, kann heute in deutlich kürzerer Zeit erzeugt und direkt verwendet werden.

Damit entsteht ein neuer Standard für digitale Inhalte.

Der Wendepunkt der 3D-Erfassung

Die bisherigen Verfahren der 3D-Erfassung zeigen klar ihre jeweiligen Stärken, aber auch ihre Grenzen. LiDAR liefert präzise Geometrie, während Photogrammetrie visuelle Realität erzeugt. In der Praxis bedeutet das jedoch häufig Kompromisse zwischen Genauigkeit, Aufwand und Ergebnisqualität.

Genau diese Trennung wird zunehmend aufgelöst.

Neue Ansätze kombinieren Bilddaten, Sensorik und KI-gestützte Verarbeitung zu einem integrierten System. Statt einzelne Punkte oder Meshes zu berechnen, werden Szenen als volumetrische Informationen beschrieben. Gaussian Splatting nutzt dafür Millionen kleiner Punkte mit Farb- und Transparenzinformationen, die gemeinsam eine realitätsnahe Darstellung erzeugen. [1]

Der Unterschied ist fundamental. Die Realität wird nicht mehr rekonstruiert, sondern approximiert und direkt visualisiert.

- LiDAR bietet hohe geometrische Präzision, ist jedoch kostenintensiv und begrenzt in der Detailtiefe

- Photogrammetrie liefert visuelle Qualität, erfordert aber komplexe Verarbeitung und stabile Aufnahmebedingungen

- Gaussian Splatting verbindet beide Ansätze und ermöglicht eine schnelle, realitätsnahe Darstellung aus Bilddaten

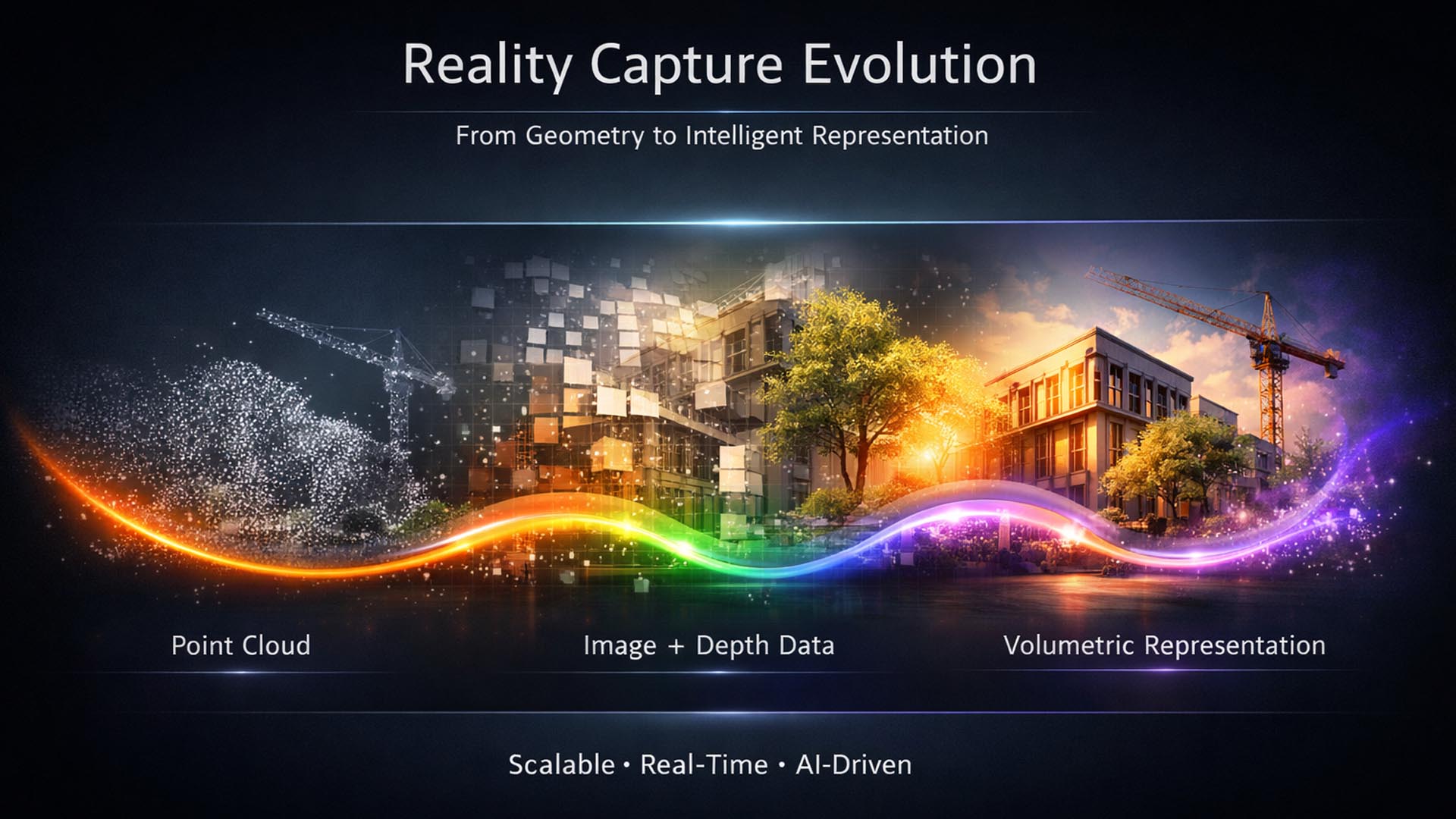

Vergleich moderner Reality-Capture-Verfahren, von klassischer Sensorik bis zu AI-basierter Darstellung

Motiv: Strategische Visualisierung | Darstellung: Kombination aus Punktwolke, Bilddaten und volumetrischer Rekonstruktion | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Das Bild verdeutlicht diesen Übergang. Während klassische Verfahren entweder geometrisch oder visuell arbeiten, zeigt sich bei modernen Ansätzen eine Verschmelzung beider Welten. Punktwolken, Bildinformationen und volumetrische Daten greifen ineinander und erzeugen ein deutlich kohärenteres Gesamtbild.

Technisch wird dies durch neue Rendering-Ansätze und GPU-optimierte Verarbeitung ermöglicht. Systeme können große Datenmengen in Echtzeit interpretieren und visuell darstellen. Dadurch wird die Nutzung nicht nur effizienter, sondern auch deutlich zugänglicher. [4][5]

Gleichzeitig verändern sich die Anforderungen. Statt perfekter Einzelmodelle steht zunehmend die Skalierbarkeit im Fokus. Inhalte müssen schnell erzeugt, angepasst und in bestehende Systeme integriert werden können.

Genau hier liegt die eigentliche Bedeutung dieses Wandels.

3D-Erfassung wird von einem spezialisierten Prozess zu einer grundlegenden Fähigkeit digitaler Systeme. Realität wird zur Datenquelle, nicht mehr nur zur Referenz.

Im nächsten Kapitel wird deshalb analysiert, wie diese Daten konkret erfasst werden, welche Rolle Kameras, Drohnen und Sensorik spielen und warum sich der Zugang zu 3D-Technologie aktuell so stark verändert.

Wie Reality Capture heute skalierbar wird

Im ersten Kapitel wurde deutlich, dass sich die Art der digitalen Abbildung grundlegend verändert. Im zweiten Kapitel geht es um die zentrale Voraussetzung dafür. Die Erfassung der Realität selbst.

Über lange Zeit war Reality Capture ein spezialisiertes Feld. Hochwertige 3D-Daten erforderten entweder industrielle Laserscanner oder komplexe Photogrammetrie-Workflows mit spezialisierter Software und erheblichem Zeitaufwand.

Heute verschiebt sich genau dieser Zugang.

Neue Kamerasysteme, mobile Sensorik und KI-gestützte Verarbeitung ermöglichen es, reale Umgebungen deutlich einfacher zu erfassen. Die Eintrittshürde sinkt. Gleichzeitig steigt die Qualität der Ergebnisse.

Ein entscheidender Treiber dieser Entwicklung ist die Vielfalt an verfügbaren Capture-Systemen.

- High-End Systeme wie Drohnen mit Photogrammetrie-Kameras ermöglichen großflächige und präzise Erfassung komplexer Umgebungen

- 360°-Kameras und volumetrische Capture-Systeme erzeugen immersive Datensätze mit hoher visueller Qualität

- Mobile Geräte und neue Sensorlösungen machen 3D-Erfassung erstmals für breite Anwendungen zugänglich

Moderne Reality-Capture-Systeme von professionellen Drohnen bis zu mobilen Geräten im direkten Vergleich

Motiv: Strategische Visualisierung | Darstellung: Drohne mit Photogrammetrie Kamera, 360°-Kamera Setup und Smartphone-basierte Erfassung | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Das Bild zeigt diese Entwicklung deutlich. Unterschiedliche Systeme erfassen dieselbe Realität auf unterschiedliche Weise. Während Drohnen große Areale präzise dokumentieren, ermöglichen kompakte Kameras und mobile Geräte eine flexible und schnelle Datenerfassung direkt vor Ort.

Technisch basiert dieser Fortschritt auf mehreren parallelen Entwicklungen. Hochauflösende Sensoren, verbesserte Optiken und stabile Tracking-Verfahren wie Visual SLAM ermöglichen eine kontinuierliche Erfassung von Bewegung und Raum. Gleichzeitig sorgen Softwarelösungen wie COLMAP oder OpenMVG dafür, dass aus einzelnen Bildern konsistente räumliche Strukturen entstehen. [6][7]

Auch die Rolle von KI verändert den Prozess grundlegend. Systeme erkennen automatisch Strukturen, optimieren Kamerapositionen und verbessern die Rekonstruktion ohne manuelle Eingriffe. Dadurch wird der Workflow nicht nur schneller, sondern auch robuster gegenüber Fehlern. [5][8]

Ein weiterer entscheidender Faktor ist die Integration neuer Hardware. Geräte wie 360°-Kameras oder spezialisierte Capture-Systeme erzeugen bereits während der Aufnahme zusammenhängende Datensätze. Gleichzeitig zeigen Entwicklungen im Bereich Spatial Video, dass selbst Consumer-Geräte zunehmend in der Lage sind, räumliche Informationen zu erfassen. [1][4]

Damit verändert sich die Rolle der Datenerfassung grundlegend.

Capture wird nicht mehr als vorbereitender Schritt verstanden, sondern als integraler Bestandteil digitaler Prozesse. Daten entstehen dort, wo sie benötigt werden, und können unmittelbar weiterverarbeitet werden.

Die Konsequenz ist klar. 3D-Erfassung wird skalierbar.

Unternehmen sind nicht mehr darauf angewiesen, einzelne Modelle mit hohem Aufwand zu erstellen. Stattdessen können reale Umgebungen kontinuierlich erfasst, aktualisiert und in bestehende Systeme integriert werden.

Genau diese Entwicklung bildet die Grundlage für den nächsten Schritt.

Im folgenden Kapitel wird deshalb analysiert, wie diese Daten technisch verarbeitet werden und warum Gaussian Splatting dabei eine zentrale Rolle spielt.

Wie reaktive Interfaces technisch funktionieren

Wenn Interfaces auf Bewegung und Kontext reagieren, wirkt das zunächst wie ein visueller Effekt. Tatsächlich handelt es sich jedoch um ein klar strukturiertes technisches System. Der Unterschied ist entscheidend. Es geht nicht um eine Illusion, sondern um das präzise Zusammenspiel mehrerer Komponenten, die gemeinsam eine stabile Interaktion ermöglichen.

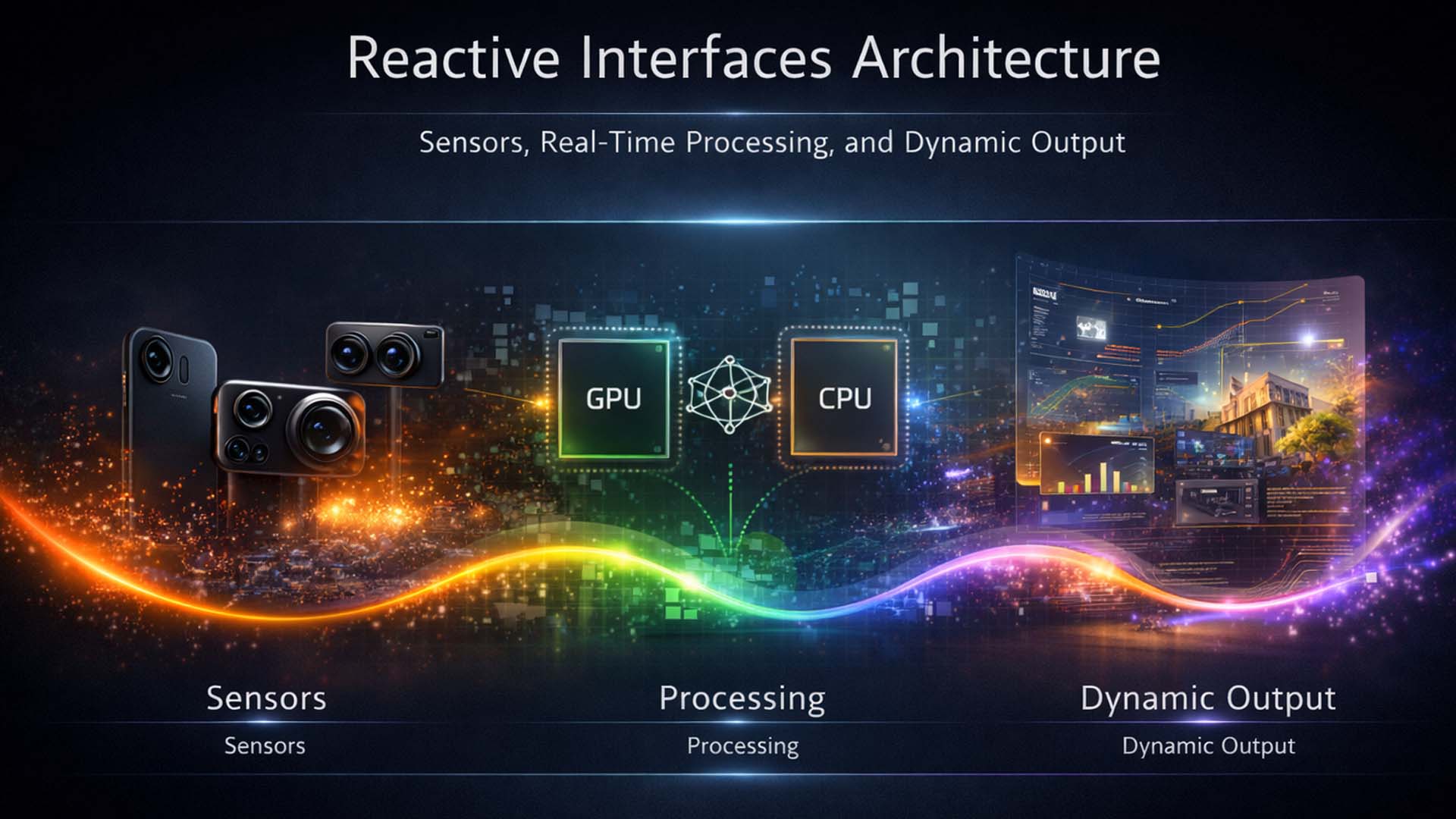

Im Kern besteht dieses System aus drei Ebenen: Sensorik, Verarbeitung und visueller Ausgabe. Erst wenn diese Elemente synchron zusammenarbeiten, entsteht der Eindruck eines Systems, das direkt auf den Nutzer reagiert. [12]

Die Sensorik übernimmt dabei die Rolle der Eingabe. Kameras oder andere Sensoren erfassen kontinuierlich die Position und Bewegung des Nutzers. Ohne diese Daten bleibt das Interface statisch und reagiert nicht auf den Kontext.

Genau hier setzt die zweite Ebene an. Die Verarbeitung erfolgt in Echtzeit, oft direkt im Browser oder lokal auf dem Gerät. KI Modelle interpretieren die Daten und übersetzen sie in verwertbare Informationen. Ohne diese Verarbeitung würde die Bewegung zwar erfasst, aber nicht sinnvoll genutzt werden. [16]

Die visuelle Ausgabe entsteht erst durch die Kombination dieser beiden Ebenen. Eine Engine wie Three.js passt Perspektive, Kamera und Darstellung kontinuierlich an und erzeugt so den Eindruck von Tiefe und räumlicher Präsenz. Dabei handelt es sich nicht um echte physische Tiefe, sondern um eine präzise berechnete visuelle Simulation. [11]

- Sensorik → erfasst Bewegung und Position des Nutzers in Echtzeit

- Verarbeitung → interpretiert Daten lokal und übersetzt sie in Interaktionslogik

- Visuelle Ausgabe → passt Darstellung dynamisch an und erzeugt räumliche Wirkung

Technische Architektur reaktiver Interfaces, Zusammenspiel aus Sensorik, Echtzeitverarbeitung und dynamischer Darstellung

Grafik: Redaktionelle Systemdarstellung | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Die Grafik zeigt das System als zusammenhängende Architektur. Links befindet sich die Sensorik, die kontinuierlich Daten erfasst. In der Mitte erfolgt die Verarbeitung, die diese Daten interpretiert und in Steuerlogik übersetzt. Rechts entsteht die visuelle Ausgabe, die sich dynamisch anpasst.

Entscheidend ist dabei nicht nur die Technologie selbst, sondern deren Stabilität. Latenz, Genauigkeit und Synchronisation bestimmen, ob das System überzeugend wirkt oder nicht. Schon kleine Verzögerungen können die Wahrnehmung deutlich beeinträchtigen. [7]

Zusätzlich wird deutlich, dass solche Systeme nicht isoliert funktionieren. Datenströme, Rendering und Interaktionslogik müssen exakt aufeinander abgestimmt sein. Erst durch diese Integration entsteht ein Interface, das konsistent und zuverlässig reagiert.

Auch Sicherheits- und Betriebsaspekte spielen eine Rolle. Sobald Kameradaten verarbeitet werden, entstehen Anforderungen an Datenschutz, Zugriff und Systemkontrolle, die Teil der Architektur werden müssen. [4]

Damit wird klar, dass reaktive Interfaces kein reines Frontend Thema sind. Es handelt sich um eine Systemarchitektur, die Daten, Logik und Darstellung verbindet. Genau dieser Unterschied entscheidet darüber, ob ein Interface nur beeindruckt oder tatsächlich funktioniert.

Im nächsten Kapitel wird deshalb analysiert, in welchen konkreten Anwendungsfeldern diese Systeme echten Mehrwert liefern.

Mehrwert und Einsatzfelder reaktiver Interfaces

Im vorherigen Kapitel wurde sichtbar, wie diese Systeme technisch aufgebaut sind. Sensorik, Verarbeitung und visuelle Anpassung erzeugen gemeinsam ein Interface, das nicht mehr statisch ist. Im nächsten Schritt stellt sich deshalb die entscheidende Frage, in welchen Situationen dieser Ansatz tatsächlich überlegen ist.

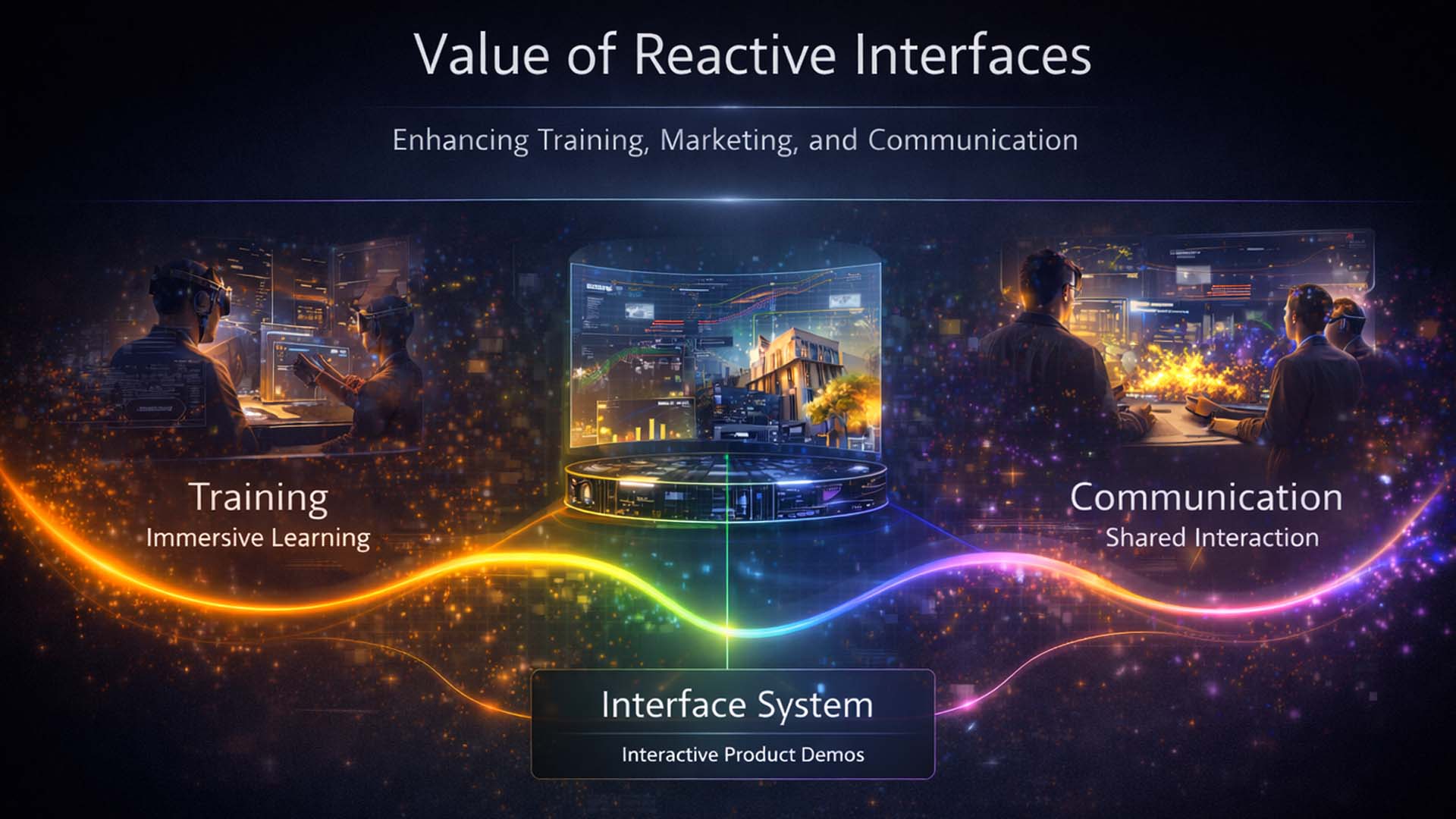

Genau hier beginnt der praktische Nutzen. Reaktive Interfaces sind besonders stark, wenn Informationen nicht nur gelesen, sondern verstanden werden müssen. Sobald Bewegung, Perspektive und Kontext eine Rolle spielen, entsteht ein klarer Vorteil gegenüber klassischen Interfaces. [15]

- Training und Simulation → Inhalte werden durch Interaktion schneller verständlich

- Produktpräsentation → Systeme reagieren auf Nutzer und wirken dadurch greifbarer

- Kommunikation und Entscheidung → Gemeinsame Interaktion schafft ein besseres Verständnis

Reaktive Interface Use Cases, Einsatzfelder zwischen Training, Kommunikation und interaktiver Produktdarstellung

Grafik: Redaktionelle Analyse | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Die Grafik verdichtet diese Einsatzfelder zu einer klaren Struktur. Im Zentrum steht das Interface System. Darum herum entstehen Kontexte, in denen der Mehrwert besonders deutlich wird.

Im Training ermöglicht die dynamische Anpassung ein schnelleres Verständnis komplexer Inhalte. Nutzer interagieren direkt mit dem System, statt nur Informationen zu konsumieren. [17]

Im Vertrieb und in der Produktdarstellung entsteht ein weiterer Vorteil. Systeme reagieren auf den Nutzer und erzeugen dadurch eine stärkere Wahrnehmung von Qualität und Funktion.

Im Bereich Kommunikation zeigt sich ein dritter Effekt. Wenn mehrere Personen mit einem System interagieren, entsteht ein gemeinsamer Bezugspunkt. Entscheidungen basieren nicht mehr auf individuellen Screens, sondern auf einer geteilten Interaktion.

Gleichzeitig zeigt sich auch die Grenze. Nicht jede Anwendung profitiert von reaktiven Interfaces. Für standardisierte Prozesse oder präzise Dateneingabe bleiben klassische Interfaces effizienter. [20]

Der Mehrwert entsteht also nicht durch Technologie allein, sondern durch den richtigen Einsatzkontext. Unternehmen, die diese Differenzierung verstehen, können Interfaces gezielt dort einsetzen, wo sie Wirkung entfalten.

Im nächsten Kapitel wird deshalb analysiert, welche Anforderungen entstehen, wenn aus einer Demo ein dauerhaft betriebenes System wird.

Vom Prototyp zur Plattform, Anforderungen im Betrieb

Nachdem die technologischen Grundlagen und Einsatzfelder beschrieben wurden, verschiebt sich der Fokus in diesem Kapitel auf eine oft unterschätzte Dimension. Die eigentliche Herausforderung beginnt nicht bei der Demonstration, sondern beim Betrieb.

Ein reaktives Interface kann als einzelnes Setup überzeugend wirken. Doch sobald es in reale Prozesse integriert wird, entstehen Anforderungen, die über die Visualisierung hinausgehen. Systeme müssen stabil laufen, sicher betrieben werden und organisatorisch eingebettet sein.

Genau an diesem Punkt verändert sich die Perspektive. Aus einem Interface wird ein System, das geplant, betrieben und kontinuierlich optimiert werden muss. Studien zur Integration neuer Technologien zeigen, dass insbesondere Struktur und Betrieb entscheidend für nachhaltige Nutzung sind. [15]

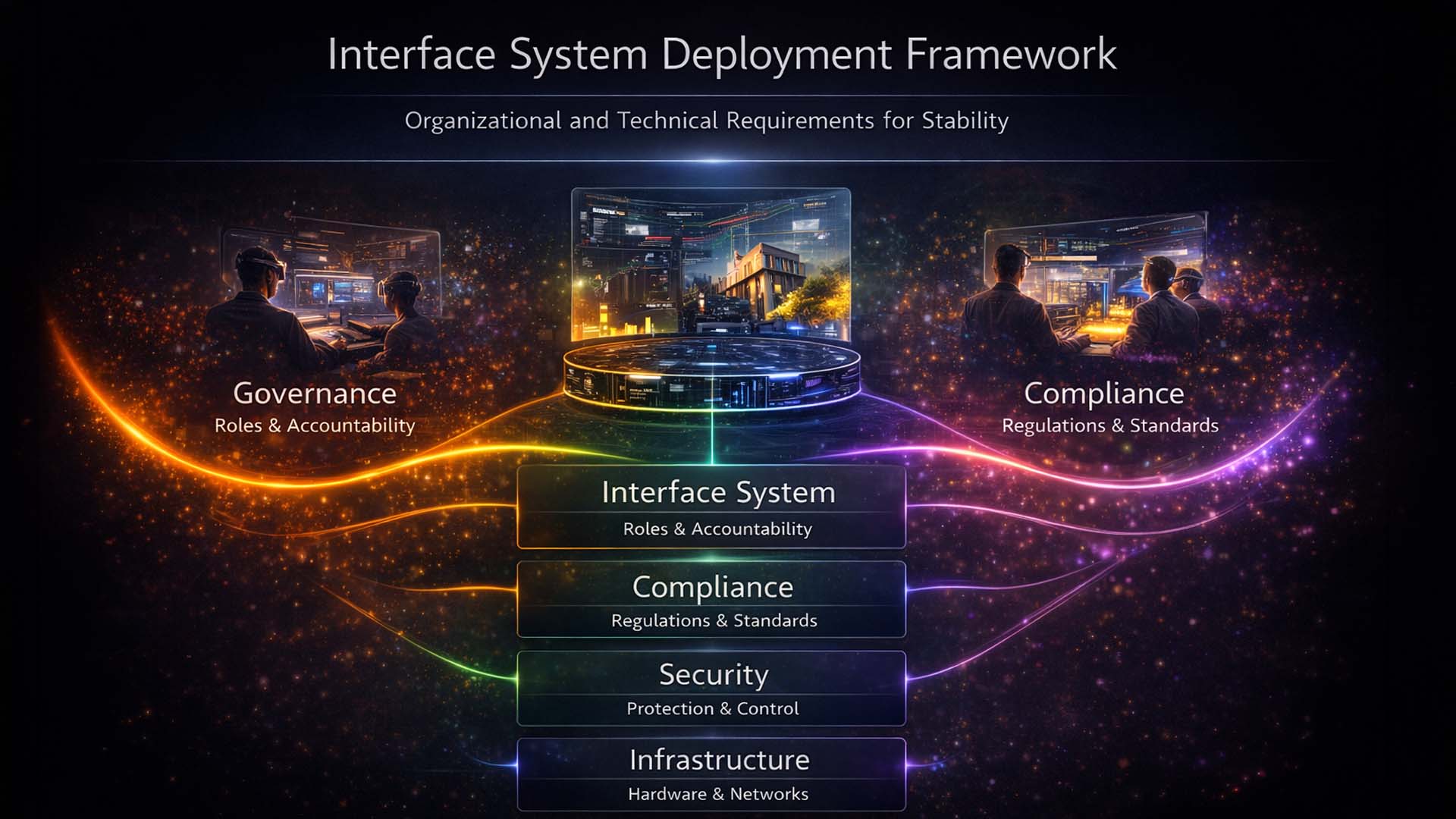

- Von Demo zu Betrieb → Systeme müssen dauerhaft stabil funktionieren

- Von Effekt zu Struktur → Organisation und Prozesse werden Teil der Lösung

- Von Einzelanwendung zu Plattform → Skalierbarkeit wird entscheidend

Interface System Deployment Framework, organisatorische und technische Anforderungen für den stabilen Betrieb

Grafik: Redaktionelle Framework-Analyse | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Die Grafik zeigt die notwendigen Ebenen für den Betrieb solcher Systeme. Sie reduziert das Thema bewusst auf eine klare Struktur.

„Governance“ beschreibt die Steuerung. Rollen, Verantwortlichkeiten und Entscheidungsprozesse müssen klar definiert sein, damit Systeme kontrolliert betrieben werden können. [18]

„Compliance“ umfasst regulatorische Anforderungen und Standards. Gerade bei der Verarbeitung von Nutzerdaten entstehen klare Vorgaben, die eingehalten werden müssen. [4]

„Security“ adressiert den Schutz der Systeme. Daten, Zugriffe und Schnittstellen müssen abgesichert werden, insbesondere wenn Systeme vernetzt sind.

„Operations“ beschreibt den laufenden Betrieb. Monitoring, Wartung und Performance bestimmen, ob ein System langfristig nutzbar bleibt.

Die unterste Ebene „Infrastructure“ bildet die technische Grundlage. Hardware, Netzwerk und Laufzeitumgebung entscheiden darüber, ob das System stabil funktioniert.

Die zentrale Erkenntnis ist klar. Der Erfolg solcher Systeme hängt nicht von der Visualisierung ab, sondern von der Fähigkeit, sie als Plattform zu betreiben. Technologie allein reicht nicht aus.

Im nächsten Kapitel wird deshalb analysiert, welche strategische Bedeutung sich daraus für Unternehmen ergibt.

Gaussian Splatting als digitale Infrastruktur

Mit den vorherigen Kapiteln ist die technologische Entwicklung vollständig beschrieben. Im letzten Kapitel verschiebt sich der Fokus auf die strategische Bedeutung. Gaussian Splatting ist nicht nur eine neue Methode zur Darstellung von Realität, sondern entwickelt sich zu einer grundlegenden Infrastruktur für digitale Systeme.

Genau dieser Unterschied ist entscheidend.

Viele Technologien bleiben isolierte Lösungen. Sie lösen ein spezifisches Problem, ohne dauerhaft Teil der Wertschöpfung zu werden. Gaussian Splatting folgt einer anderen Logik. Es verbindet Datenerfassung, Visualisierung und Interaktion zu einem durchgängigen System. [3][4]

Damit entsteht eine neue Grundlage für digitale Anwendungen.

- Reality Capture wird zur kontinuierlichen Datenquelle statt einmaligem Prozess

- Visualisierung wird Teil operativer Systeme und nicht nur Präsentation

- Interaktion entwickelt sich von Bedienung zu direkter Entscheidungsunterstützung

Gaussian Splatting als Verbindungsschicht zwischen Realität, Daten und digitalen Plattformen

Motiv: Strategische Visualisierung | Darstellung: unten reale Welt und Datenerfassung, Mitte Gaussian Splatting als Daten- und Visualisierungsschicht, oben Anwendungen wie Digital Twins, XR und Simulation | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Die Grafik zeigt Gaussian Splatting nicht als isolierte Technologie, sondern als verbindende Schicht innerhalb einer digitalen Architektur. Am unteren Rand steht die physische Realität, erfasst durch Kameras, Sensoren und Drohnen. Darüber entsteht eine strukturierte Datenebene, in der Informationen verarbeitet und für Anwendungen zugänglich gemacht werden.

Gaussian Splatting übernimmt in diesem Modell eine zentrale Rolle. Es übersetzt reale Umgebungen in eine Form, die sowohl visuell verständlich als auch technisch effizient ist.

Darauf aufbauend entstehen Anwendungen.

Digitale Zwillinge, industrielle Simulationen oder immersive XR-Erlebnisse greifen auf diese Daten zu und machen sie nutzbar. Plattformen wie NVIDIA Omniverse zeigen bereits heute, wie solche Systeme in realen Produktionsumgebungen eingesetzt werden. [2]

Auch auf strategischer Ebene wird diese Entwicklung sichtbar.

Analysen von McKinsey, Gartner und dem World Economic Forum zeigen, dass sich digitale Systeme zunehmend in Richtung räumlicher, kontextbasierter Interaktion entwickeln. Daten werden nicht mehr nur analysiert, sondern direkt erlebbar gemacht. [3][5]

Damit verändert sich auch die Rolle von Unternehmen.

Wer diese Technologien früh integriert, schafft sich nicht nur einen visuellen Vorteil, sondern eine neue Form der Datennutzung. Prozesse werden transparenter, Entscheidungen schneller und Systeme flexibler.

Gleichzeitig entsteht ein klarer Trend.

Reality Capture entwickelt sich zur Basis vieler digitaler Geschäftsmodelle. Gaussian Splatting wird dabei zur Brücke zwischen physischer und digitaler Welt.

Die zentrale Erkenntnis ist eindeutig.

Gaussian Splatting ist kein Feature.

Es ist Infrastruktur.

Damit schließt sich der Kreis dieses Artikels. Von der Erfassung über die Verarbeitung bis hin zur strategischen Einordnung entsteht ein zusammenhängendes Bild einer Technologie, die nicht nur Visualisierung verändert, sondern die Art, wie digitale Systeme aufgebaut und genutzt werden.

Von der Erfassung zur Erfahrung

Das folgende Video zeigt kompakt, wie Reality Capture, neue 3D-Repräsentationen und KI-gestützte Verarbeitung heute zusammenwirken. Im Mittelpunkt steht Gaussian Splatting als neuer Ansatz, reale Szenen nicht nur zu erfassen, sondern deutlich flexibler, performanter und visuell überzeugender nutzbar zu machen. [22]

Statt einen einzelnen Workflow zu zeigen, macht das Video die Breite des Feldes sichtbar. Es verbindet kamerabasierte Erfassung, volumetrische Rekonstruktion und neue Präsentationsformen zu einem Gesamtbild, das die aktuelle Dynamik dieser Technologie sehr gut verdichtet. [22][23]

Gleichzeitig wird deutlich, warum das Thema gerade so relevant ist. Reality Capture entwickelt sich von einem Spezialprozess zu einer skalierbaren Grundlage für Visualisierung, Simulation und neue digitale Anwendungen. Genau hier zeigt sich auch die Rolle neuer Hardware und Capture-Systeme, die räumliche Daten schneller und zugänglicher erzeugen können. [22][24]

Das Video verdeutlicht damit einen zentralen Wandel. Realität wird nicht mehr nur dokumentiert, sondern direkt zur nutzbaren Datenbasis für moderne 3D-Systeme.

Reality Capture und Gaussian Splatting – Das Video verdichtet aktuelle Entwicklungen von der Erfassung realer Szenen bis zur performanten 3D-Darstellung

Videoquelle: Corridor Crew, „THIS is the Biggest Thing Since CGI“ | Ergänzende Referenzen: 4DV.ai und Antigravity A1 360 Drone | Einordnung: Ulrich Buckenlei

Diese Entwicklung zeigt klar, wohin sich digitale Systeme bewegen. Realität wird direkt zur Datenbasis und kann ohne Umwege in neue visuelle und interaktive Anwendungen überführt werden.

Quellen und Referenzen

- Kerbl et al., 3D Gaussian Splatting, SIGGRAPH, 2023. [1]

- Peng et al., RTG-SLAM mit Gaussian Splatting, SIGGRAPH, 2024. [2]

- Wei et al., 4D Gaussian Splatting, SIGGRAPH, 2024. [3]

- NVIDIA, Real-Time Gaussian Splatting, 2025. [4]

- NVIDIA, AI & RTX für Reality Capture, 2024. [5]

- Khronos Group, Gaussian Splatting Extension (glTF), 2026. [6]

- Bentley Systems, Gaussian Splatting & Digital Twins, 2026. [7]

- FOV Ventures, Gaussian Splatting als Datenlayer, 2023. [8]

- Wingtra, LiDAR vs Photogrammetrie, 2024–2026. [9]

- Anvil Labs, Drohnenvergleich LiDAR vs Photogrammetrie, 2026. [10]

- DJI, LiDAR Systeme L1–L3, 2025. [11]

- DJI, Photogrammetrie Kamera P1, 2023. [12]

- Insta360, Titan 11K VR Kamera, 2024–2026. [13]

- XGRIDS, Lixel Portal 3D Capture, 2025. [14]

- COLMAP / OpenMVG, Photogrammetrie Pipelines, 2024–2026. [15]

- Apple, Spatial Video & Computing, 2024–2026. [16]

- Meta Reality Labs, Spatial Capture & Interaction, 2024–2026. [17]

- Microsoft Research, Mixed Reality & Computer Vision, 2024–2026. [18]

- McKinsey, Technology Trends Outlook, 2025. [19]

- Gartner, Emerging Technologies & Spatial Computing, 2025–2026. [20]

- World Economic Forum, AI & immersive Technologien, 2024–2025. [21]

- Corridor Crew, „THIS is the Biggest Thing Since CGI“, YouTube, veröffentlicht am 29. März 2026. [22]

- 4DV.ai, Volumetric Capture and Reconstruction, im Video und in der Videobeschreibung referenziert, Zugriff 2026. [23]

- Antigravity, A1 360 Drone, in der Videobeschreibung als verwendete bzw. referenzierte Capture-Hardware genannt, Zugriff 2026. [24]

Von Reality Capture zu echtem Business Impact

Gaussian Splatting, AI und Spatial Computing verändern aktuell, wie Unternehmen Realität digital nutzen. Daten werden nicht nur erfasst, sondern direkt erlebbar und in Echtzeit nutzbar.

Die entscheidende Frage ist heute nicht mehr, ob diese Technologien relevant sind, sondern wie schnell sie sinnvoll eingesetzt werden können.

Viele Unternehmen haben bereits erste Ansätze. Doch oft fehlt der Weg in die Anwendung. Daten bleiben ungenutzt, Prototypen erreichen nicht den operativen Einsatz.

Genau hier setzt VISORIC an.

Von der Idee zur skalierbaren Lösung, VISORIC verbindet Technologie, Daten und Anwendung

Quelle: VISORIC GmbH | München

Wir unterstützen Unternehmen dabei, neue Technologien gezielt in reale Prozesse zu überführen.

- Strategie → Klare Roadmap statt Einzelideen

- Reality Capture → Reale Welt als digitale Datenbasis

- AI Systeme → Daten intelligent nutzbar machen

- Interaktive Anwendungen → Inhalte erlebbar machen

- Simulation → Prozesse besser verstehen und optimieren

- Integration → Nahtlose Einbindung in bestehende Systeme

- Prototyping → Schnell testen und fundiert entscheiden

Der Unterschied entsteht in der Umsetzung.

Unternehmen, die jetzt starten, schaffen sich klare Vorteile in Effizienz, Geschwindigkeit und Entscheidungsqualität.

Erfahren Sie mehr über unsere Lösungen im Bereich Gaussian Splatting:

www.visoric.com/gaussian-splatting

Oder nutzen Sie das Kontaktformular, um konkrete Ansätze für Ihr Unternehmen zu entwickeln.

Kontaktpersonen: Nataliya Daniltseva (Projektleiterin) Adresse:

Ulrich Buckenlei (Kreativdirektor)

Mobil: +49 152 53532871

E-Mail: ulrich.buckenlei@visoric.com

Mobil: + 49 176 72805705

E-Mail: nataliya.daniltseva@visoric.com

VISORIC GmbH

Bayerstraße 13

D-80335 München