Bild: Digitales Fahrzeugmodell im Echtzeit-Simulationsraum

Bild: © Ulrich Buckenlei | Visoric GmbH 2025

Fahrzeuge entstehen heute zunehmend in digitalen Welten, lange bevor der erste Prototyp gebaut wird. 3D-Modelle, künstliche Intelligenz und physikalische Simulationen verschmelzen zu einem lernfähigen Ökosystem, das Design, Test und Produktion in Echtzeit verbindet. Was früher nacheinander geschah, passiert nun parallel – schneller, präziser und nachvollziehbar. Genau an dieser Schnittstelle beginnt die neue Ära der automobilen Intelligenz.

Virtuelle Intelligenz trifft mechanische Präzision

Die Entwicklung moderner Fahrzeuge startet nicht mit Ton und Windkanal, sondern mit Digital Twins. In hochauflösenden 3D-Umgebungen werden Aerodynamik, Materialverhalten und Fahrphysik simuliert – kontinuierlich ausgewertet durch KI, die Muster erkennt, Varianten vergleicht und Entscheidungen vorbereitet. Virtuelle Testreihen ersetzen so ganze hardwareintensive Phasen, ohne an Aussagekraft zu verlieren.

- Prädiktives Design → Fahrzeuge lernen im virtuellen Raum

- Echtzeitsimulation → Windkanal und Straße verschmelzen

- Datenschleifen → Jeder Test verändert reale Parameter

Bild: KI-gestützte Aerodynamiksimulation im digitalen Entwicklungsraum | Visualisierung NVIDIA Omniverse

Dieser Ansatz verändert die Rolle des 3D-Modells grundlegend: Vom statischen Datenträger wird es zum aktiven Akteur im Entwicklungsprozess. Jede virtuelle Iteration fließt messbar in die Mechanik zurück. So entsteht ein belastbares Fundament, auf dem Teams schneller entscheiden – und mit mehr Vertrauen in die Ergebnisse ins nächste Kapitel gehen.

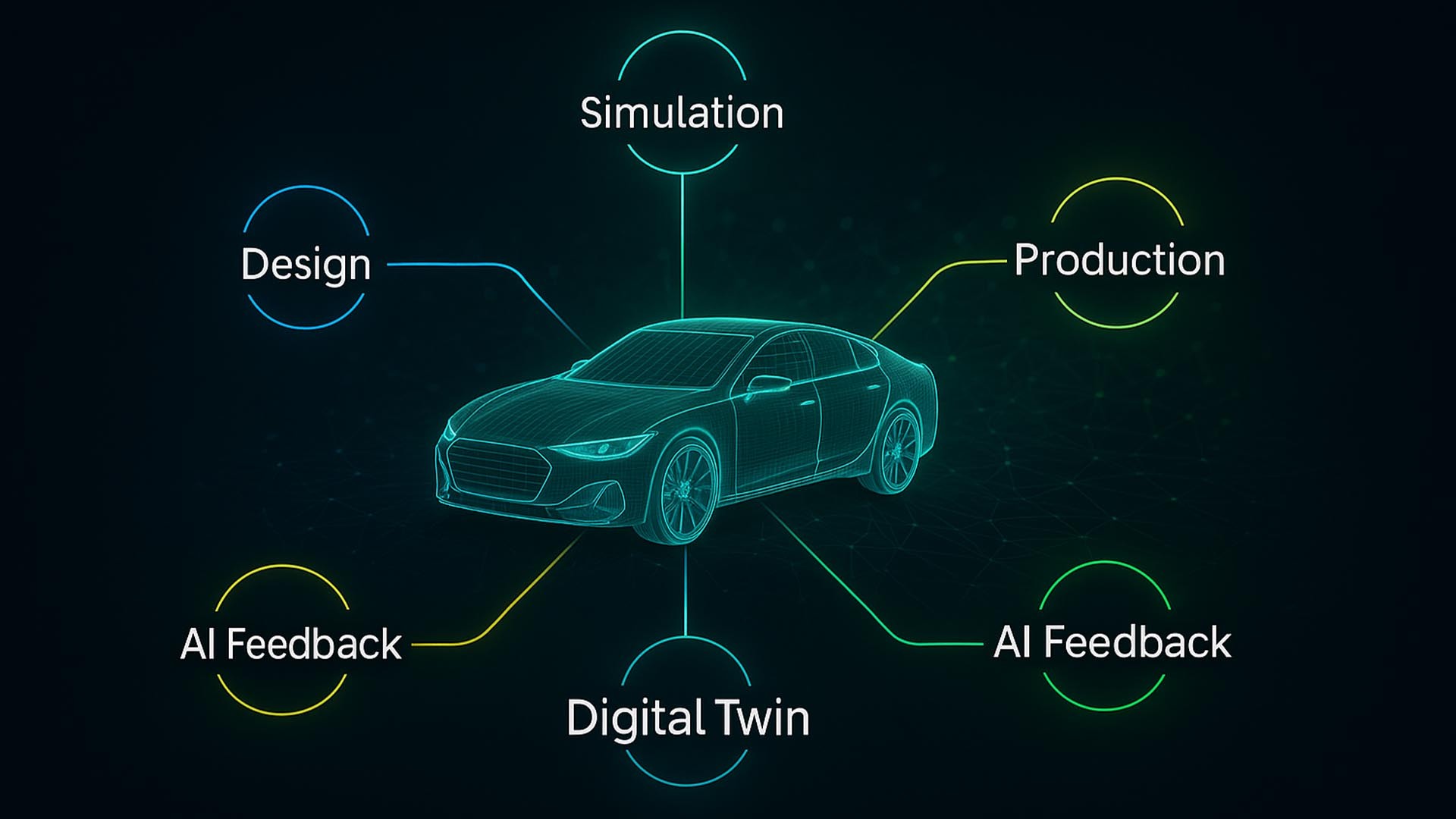

Der digitale Zwilling als neuraler Knotenpunkt

Der digitale Zwilling verbindet Bereiche, die früher getrennt waren: Engineering, UX und Fertigung. Er ist Datenbank, Simulationskern und Interface in einem – ein lebender Referenzpunkt, an dem sich alle beteiligten Disziplinen ausrichten. Unternehmen wie Mercedes-AMG oder BMW nutzen solche Modelle, um Varianten durchzuspielen, Ergonomie zu testen und Produktionsschritte vorzubereiten.

- Simulation + Sensorik + Kontrolle = Adaptive Designintelligenz

- Virtuelle Sensoren liefern Echtzeitdaten für KI-Modelle

- Jede Bewegung im 3D-Modell ersetzt reale Prototypen

Bild: Der digitale Zwilling verbindet Design, Simulation und Steuerung in Echtzeit | Visualisierung: Visoric GmbH 2025

Praktisch bedeutet das: Änderungen an Geometrie, Software oder Parametern werden nicht mehr isoliert bewertet. Der Zwilling propagiert sie durch das gesamte System – inklusive Feedback aus Tests und Produktion. Dieser synchrone Modus reduziert Reibung, beschleunigt Lernzyklen und bereitet nahtlos auf den nächsten Schritt vor: echte Interaktion zwischen Mensch und Maschine.

Von der Simulation zur Interaktion

Touch, Gesten, Blick: Moderne HMIs machen komplexe Funktionen begreifbar. Mixed-Reality-Cockpits werden zu Laboren, in denen Designer und Ingenieure Verhalten erleben, bevor es existiert. Entscheidend ist die Verbindung von Daten zu Emotion – das unmittelbare Gefühl, dass ein Entwurf richtig reagiert.

- Immersive Human-Machine-Interfaces (HMI)

- Mixed-Reality-Cockpits als Testumgebungen

- Data-to-Emotion → Design reagiert auf Nutzerintention

Bild: Mixed-Reality-Interface für Design- und UX-Tests | Visualisierung: Visoric GmbH 2025

Wenn echte Bedienung auf simulierte Mechanik trifft, wird aus einem Modell eine Erfahrung. Teams spüren Latenzen, Übergänge und Bestätigungen – und verankern Qualitätskriterien, die später serienrelevant sind. Diese Arbeitsweise ebnet den Weg in die Fabrik, in der Simulation und Produktion ein gemeinsames System bilden.

Gaming Engines & KI – die neue Automobilfabrik

Game-Engines sind längst Industriestandards. Unreal, Unity und Omniverse visualisieren nicht nur, sie simulieren: Physik, Licht, Material, Kollaboration – in Echtzeit und vernetzt. KI-Tools bereiten Daten auf, generieren Varianten und prüfen Randbedingungen. Das Ergebnis ist ein kreatives, aber hochpräzises Arbeitsumfeld.

- Gamification im Engineering

- Echtzeit-Kollaboration mit KI-Tools

- Industrial Metaverse → Produktion trifft Simulation

Bild: KI-unterstützte Echtzeitentwicklung mit Unreal Engine | Visualisierung: Visoric GmbH 2025

So lassen sich Montagereihenfolgen, Logistikflüsse und Sicherheitsabstände erleben, bevor die erste Linie steht. Entscheidungen werden erklärbar, Investitionen nachvollziehbar. Genau hier setzt die wissenschaftliche Perspektive an: Wie präzise ist die Kopplung zwischen Eingabe und Reaktion?

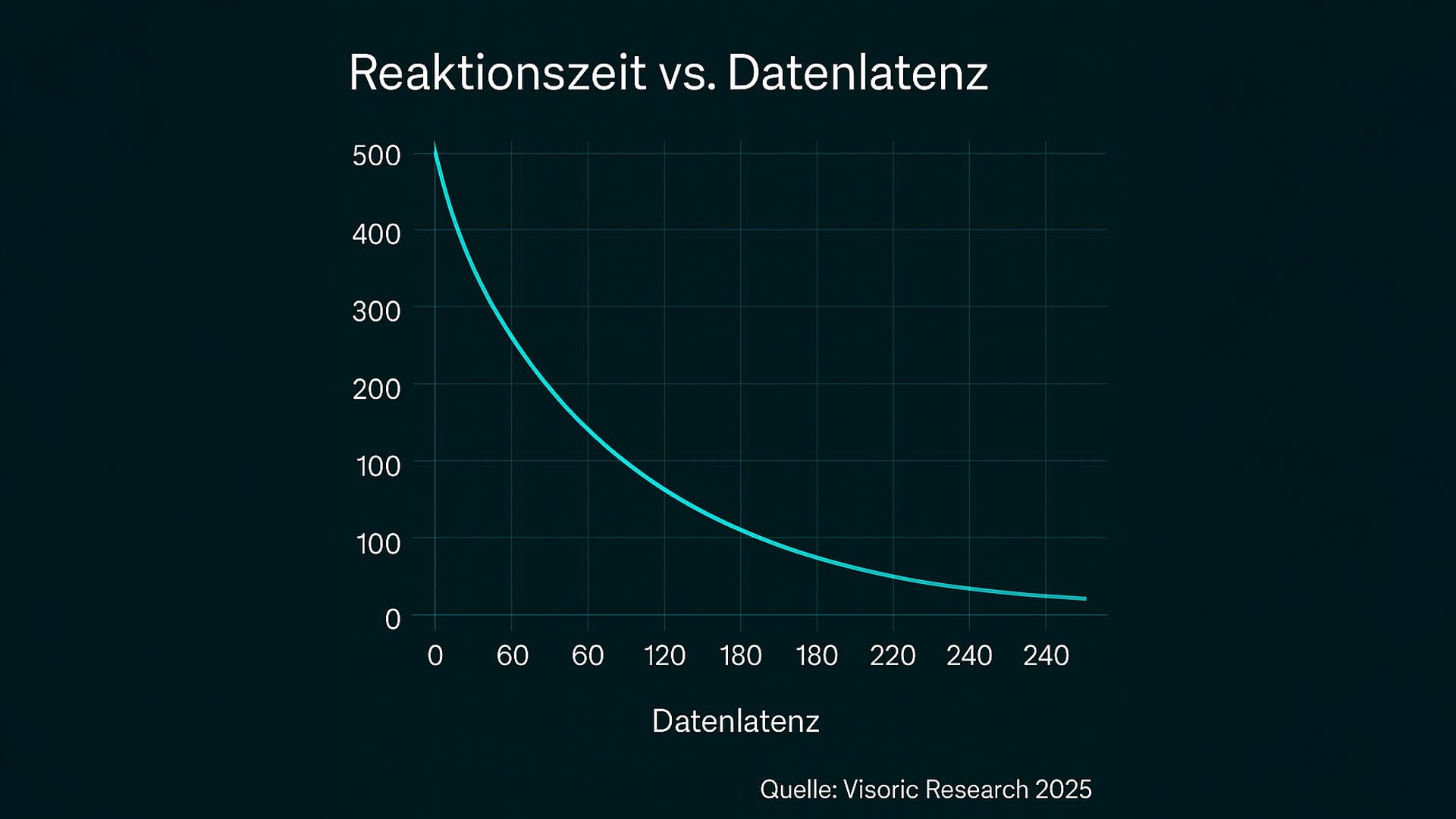

Wissenschaftliche Perspektive – Synchronität in Echtzeit

Eine Kernfrage lautet: Wie klein ist die Latenz zwischen menschlicher Aktion und visuellem Feedback? Systeme, die Rendering, Tracking und Datenzugriff synchronisieren, erzeugen sensorische Kohärenz – also das Gefühl, dass alles „aus einem Guss“ reagiert. Diese Kohärenz ist messbar und korreliert mit Präzision und Vertrauen.

Diagramm: Reaktionszeit vs. Datenlatenz | Quelle: Visoric Research 2025

Das Diagramm verdeutlicht: Wenn Echtzeit-Rendering und Datenpfade optimiert sind, sinkt die gefühlte Verzögerung zwischen Eingabe und Output signifikant. Das steigert die Trefferquote bei Interaktionen, reduziert Fehlbedienungen und liefert eine robuste Basis für die Übertragung in industrielle Umgebungen, in denen jede Millisekunde zählt.

Industrial Metaverse & Cross-Industry Impact

Die 3D-Intelligenz des Fahrzeugs ist keine Insellösung. Dieselben Prinzipien treiben Robotik, Energie- und Produktionssysteme: ein gemeinsamer 3D-Raum, in dem Daten, Menschen und Maschinen synchron arbeiten. OEMs und Zulieferer teilen Modelle, testen Abläufe und orchestrieren Lieferketten – live und nachvollziehbar.

- Gemeinsame 3D-Plattformen zwischen OEMs und Zulieferern

- Transfer von Automotive zu Industrie 4.0

- Die Zukunft wird nicht gebaut – sie wird simuliert

Bild: 3D-Simulationsnetzwerke im Industrial Metaverse | Visualisierung: Visoric GmbH 2025

Was im Automotive-Bereich als Aerodynamik-Optimierung begann, skaliert zur Planung ganzer Werke. Wenn alle auf dasselbe Modell schauen – und es in Echtzeit verändern – werden Entscheidungen schneller, Risiken kleiner und Qualität konstanter. Bevor wir zum Aufruf kommen, zeigt ein kurzes Beispiel die Kraft dieser Kopplung.

Interaktive Fahrzeugsteuerung – wenn 3D zum Bedienkonzept wird

Das Videobeispiel zeigt eine Fahrzeug-UI, die direkt auf einem interaktiven 3D-Gamemodell basiert. Funktionen wie Spoiler, Lichter oder Fahrwerksmodi lassen sich in Echtzeit ein- und ausschalten – sichtbar, begreifbar und ohne Umwege über abstrakte Menüs. Die Kombination aus Physiksimulation, Rendering und Interface-Logik erzeugt ein unmittelbares Gefühl von Kontrolle.

- Realtime-Feedback zwischen Touch-Geste und mechanischer Reaktion

- Ein UI, das auf einem 3D-Game-Model basiert und Zustände sichtbar macht

- Übertragbar auf Robotik, Produktionszellen und industrielle Dashboards

© Video: VIP Collector I Design Gorden Wagner I Engineering: Mercedes-AMG

Der Clip verdeutlicht, wie Bedienung, Visualisierung und Physik zu einer fließenden Erfahrung verschmelzen: Jede Eingabe verändert das Modell – und das Modell steuert die reale Funktion.

Zukunft gestalten – Mit 3D-Intelligenz zur realen Performance

Das Münchner Visoric-Team unterstützt Unternehmen dabei, digitale Zwillinge, Echtzeitsimulation und intuitive Interfaces in produktive Lösungen zu übersetzen. Von der ersten Idee bis zur produktionsreifen Anwendung entstehen klare Schritte, messbare Ergebnisse und erlebbarer Mehrwert.

- Beratung & Konzept: Vom Use Case zur belastbaren Roadmap

- Entwicklung & Integration: KI, XR, Realtime-3D und Datenanbindung

- Rollout & Training: Sichere Einführung, Skalierung und Enablement

Gemeinsam finden wir den schnellsten Weg vom virtuellen Test zur realen Performance – präzise, nachvollziehbar und inspiriert von exzellentem Design.

Kontaktpersonen:

Ulrich Buckenlei (Kreativdirektor)

Mobil: +49 152 53532871

E-Mail: ulrich.buckenlei@visoric.com

Nataliya Daniltseva (Projektleiterin)

Mobil: + 49 176 72805705

E-Mail: nataliya.daniltseva@visoric.com

Adresse:

VISORIC GmbH

Bayerstraße 13

D-80335 München