AI im Cockpit – von statisch zu adaptiv

Visualisierung : Ulrich Buckenlei I Visoric GmbH

Das Cockpit der Zukunft denkt mit. Künstliche Intelligenz verändert nicht nur, wie Anzeigen aussehen, sondern wie sie auf Fahrer und Situation reagieren. Was einst starre Bedienkonzepte mit Knöpfen, Drehreglern und festen Menüstrukturen waren, entwickelt sich zu hochgradig adaptiven, lernfähigen Interfaces, die auf Sprache, Gesten, Blickbewegungen und Kontext reagieren.

AI als Gamechanger im Cockpit-Design

Traditionelle User Interfaces im Auto folgten jahrzehntelang festen Designmustern. Mit der Integration von AI können Bedienelemente heute dynamisch gestaltet werden. Systeme passen ihre Anordnung, Priorität und Darstellungsweise in Echtzeit an den Kontext und die Bedürfnisse des Fahrers an – das Interface wird vom starren Instrument zum mitdenkenden Assistenten.

- Adaptive Layouts → Passen sich an Fahrmodus, Wetter und Umgebung an.

- Predictive Interfaces → Schlagen Funktionen vor, bevor sie benötigt werden.

- Ergonomie durch AI → Berücksichtigt individuelle Vorlieben und Gewohnheiten.

AI als Gamechanger im Cockpit-Design

Visualisierung : Ulrich Buckenlei I Visoric GmbH

Mit AI werden Cockpits kontextsensitiv – Inhalte folgen Situation und Bedarf.

Dieser Wandel schafft die Basis für eine neue Form der Mensch-Maschine-Interaktion: Das Fahrzeug versteht den Fahrer – nicht nur, was er berührt, sondern auch, was er braucht.

Intelligente Interaktion: Kontext verstehen statt Menüs durchsuchen

AI erkennt nicht nur den Fahrzustand, sondern auch das Verhalten und die Aufmerksamkeit des Fahrers. Mithilfe von Eye-Tracking, Sensordaten und Fahrstilanalyse werden Inhalte priorisiert. Unwichtige Anzeigen treten zurück, sicherheitsrelevante Signale rücken in den Vordergrund – Ablenkung sinkt, Klarheit steigt.

- Eye-Tracking → Blickbasierte Gewichtung von Informationen.

- Aufmerksamkeitsmodell → Dynamische Priorisierung je nach Situation.

- Minimal Distraction → Smarte Reduktion, wenn die Fahraufgabe anspruchsvoll ist.

AI als Gamechanger im Cockpit-Design

Visualisierung : Ulrich Buckenlei I Visoric GmbH

Das System erkennt, wann Information hilft – und wann sie stört.

Mit diesem Verständnis lassen sich Interfaces präziser testen und optimieren – ohne sofort physische Prototypen zu bauen: Die nächste Stufe ist virtuelle Erprobung.

Virtuelle Testumgebungen: Simulation statt Serienprototyp

VR- und MR-Headsets ermöglichen realistische Cockpit-Simulationen – mit wechselnden Lichtbedingungen, Wetterszenarien und Verkehrssituationen. Teams prüfen Lesbarkeit, Interaktionspfade und Sicherheit, bevor das erste Bauteil gefertigt wird. Iterationen werden schneller, Risiken sinken.

- VR/MR-Cockpits → Frühzeitige, immersive Tests im Kontext.

- Szenarienvielfalt → Tag/Nacht, Stadt/Autobahn, Regen/Nebel.

- Time-to-Decision → Kürzere Zyklen, fundiertere Entscheidungen.

AI als Gamechanger im Cockpit-Design

Visualisierung : Ulrich Buckenlei I Visoric GmbH

Virtuelle Tests zeigen früh, was später im Fahrzeug intuitiv funktionieren muss.

Die virtuelle Erprobung öffnet den Weg zu hochrealistischen Visualisierungen – sie machen das Verhalten des Interfaces vor der Produktion erlebbar.

Hochrealistische 3D-Visualisierungen: Verhalten sehen, bevor es existiert

Fotorealistische 3D-Renderings und Animationen zeigen nicht nur, wie das Interface aussieht, sondern wie es reagiert: Motion-States, Übergänge, Feedbacks. So werden Designoptionen greifbar, Diskussionen faktenbasiert – und die Zusammenarbeit zwischen UX, Engineering und Management beschleunigt.

- Render & Motion → Visualisiert Zustände, Übergänge, Mikro-Interaktionen.

- Design-Alignment → Gemeinsame Sprache für UX, Tech & Business.

- Entscheidungsreife → Weniger Annahmen, mehr Evidenz.

Verhalten sehen, bevor es existiert

Visualisierung : Ulrich Buckenlei I Visoric GmbH

Visualisierungen machen UX-Details sichtbar – bevor Hardware entsteht.

Doch wirklich adaptiv werden Interfaces erst, wenn reale Nutzung zurückspielt: Digitale Zwillinge koppeln virtuelle Cockpits mit echten Sensordaten.

Digitale Zwillinge: Lernen aus realer Nutzung

Digitale Zwillinge verbinden das virtuelle Cockpit mit Daten aus der Praxis. AI lernt, welche Anzeigen in welcher Situation die höchste Relevanz haben – und optimiert Logiken kontinuierlich. Erkenntnisse fließen per Update ins Fahrzeug zurück: Das Interface reift beim Einsatz.

- Virtuelles Cockpit + Realdaten → Relevanz statt Fülle.

- Continuous Improvement → Updates auf Basis echter Nutzung.

- Sicherheitsgewinn → Besseres Timing, klarere Hinweise, weniger Ablenkung.

Digitale Zwillinge: Lernen aus realer Nutzung

Visualisierung : NVIDIA

Der digitale Zwilling macht das Cockpit zum lernenden System.

Aus diesem Kreislauf entsteht eine Entwicklungslogik, die schneller und präziser ist – und die Grundlage für erlebbares Lernen im Bewegtbild liefert.

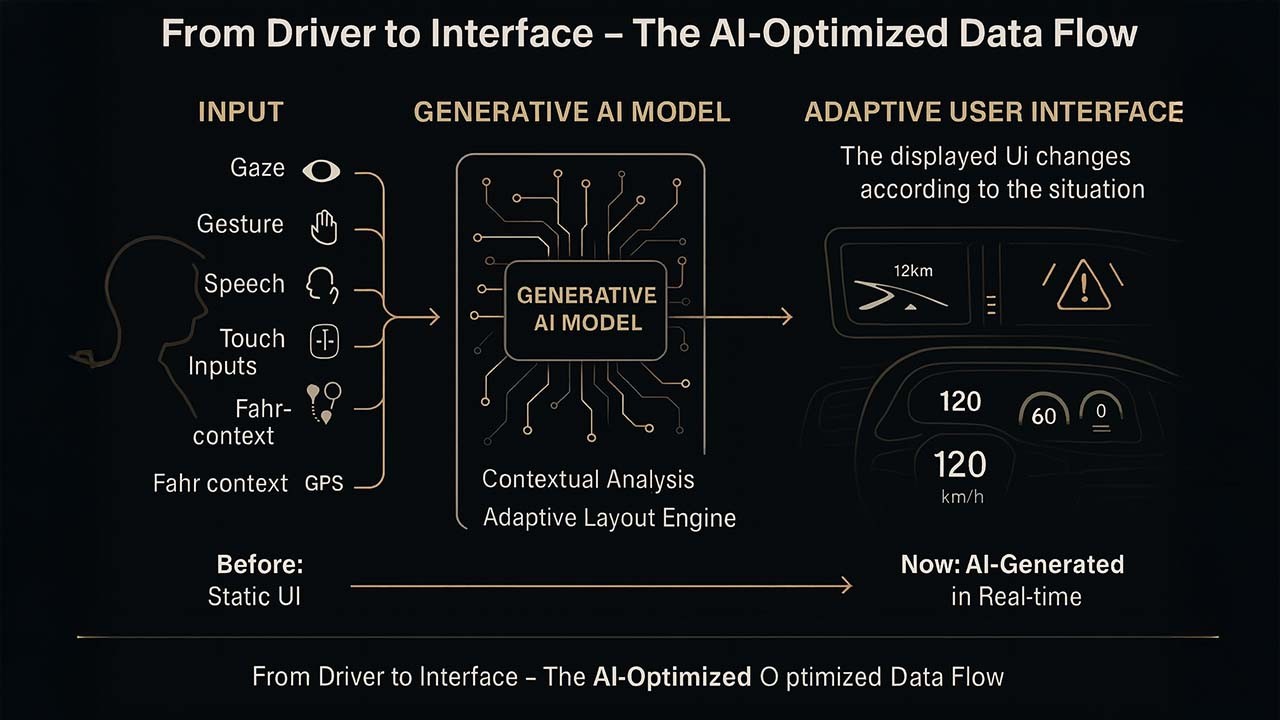

Vom Fahrer zum Interface – der AI-optimierte Datenfluss

Die Grafik zeigt, wie moderne Fahrzeuge Eingaben des Fahrers – von Blickrichtung über Gesten bis hin zu Sprach- und Touch-Kommandos sowie Fahrkontextdaten – in Echtzeit erfassen und durch ein generatives AI-Modell verarbeiten. Das Ergebnis ist ein adaptives User Interface, das sich situativ anpasst und Sicherheit, Komfort und Bedienfreundlichkeit erhöht.

- Multimodale Eingaben → Kombination aus Blick-, Sprach-, Gesten- und Touch-Steuerung plus Fahrkontext.

- Generatives AI-Modell → Kontextanalyse und adaptive Layout-Erstellung in Echtzeit.

- Adaptives UI → Dynamische Priorisierung und Darstellung je nach Situation (z. B. Navigation, Warnungen, Effizienz).

Vom Fahrer zum Interface – der AI-optimierte Datenfluss

Infografik: Ulrich Buckenlei I Visoric GmbH

So erhalten Fahrer genau die Informationen, die in diesem Moment relevant sind – im richtigen Detailgrad und Format, ohne zusätzlich zu beanspruchen.

Video: Das adaptive Cockpit in Aktion

„AI Design Showdown: Vercel vs Figma Make“

Video:: Original video by Blueshift

Kontaktieren Sie unser Experten-Team

Das Visoric Team unterstützt Unternehmen bei der Umsetzung intelligenter Interfaces, immersiver Exponate und physisch-digitaler Echtzeitsysteme – von der Ideenentwicklung bis zur produktionsreifen Integration.

- Technische Machbarkeitsstudien: individuell, realistisch, lösungsorientiert

- Konzeption & Prototyping: von der Datenquelle bis zur fertigen Oberfläche

- Integration & Skalierung: für Showroom, Messe, Entwicklung oder Vertrieb

Jetzt Kontakt aufnehmen – und gemeinsam die Zukunft der Interaktion gestalten.

Kontaktpersonen:

Ulrich Buckenlei (Kreativdirektor)

Mobil: +49 152 53532871

E-Mail: ulrich.buckenlei@visoric.com

Nataliya Daniltseva (Projektleiterin)

Mobil: + 49 176 72805705

E-Mail: nataliya.daniltseva@visoric.com

Adresse:

VISORIC GmbH

Bayerstraße 13

D-80335 München