Wenn das Labor in den Browser wandert

Redaktionelles Konzeptbild | Motiv: Browserbasierte Schaltungssimulation als digitaler Prüfstand | Visualisierung: © Ulrich Buckenlei | Visoric GmbH | Die Darstellung dient der analytischen Einordnung und erhebt keinen Anspruch auf technische Vollständigkeit

Engineering war über Jahrzehnte an physische Orte gebunden. Werkbänke, Labore, Teststände und Prototypenräume bestimmten das Tempo der Entwicklung. Wer ein System prüfen wollte, brauchte Material, Infrastruktur und Zeit. Jede Iteration bedeutete Aufbau, Messung, Umbau und erneuten Test.

Diese Logik war nicht ineffizient, sie war materiell organisiert. Geschwindigkeit hing von Verfügbarkeit ab. Von Bauteilen, von Maschinen, von Fachpersonal. Entwicklung war immer auch eine Frage physischer Koordination.

Heute entsteht eine zusätzliche Ebene innerhalb dieser Architektur. Mechanische Bewegungsabläufe, elektrische Schaltungen oder komplette Prozessketten lassen sich im Browser modellieren und in Echtzeit ausführen. Parameter können angepasst, Varianten erzeugt und unmittelbar verglichen werden. Nicht als statische Visualisierung, sondern als funktionales Verhalten eines digitalen Systems.

Die entscheidende Verschiebung liegt nicht im Ersatz realer Entwicklung, sondern im Ort der frühen Validierung. Wenn erste Tests und Optimierungen nicht mehr zwingend am physischen Objekt stattfinden müssen, sondern in einer webbasierten Simulationsumgebung, verändert sich der strukturelle Engpass des Engineerings.

Ein Digital Twin ist laut ISO 23247 Teil 1 kein bloßes 3D-Modell, sondern ein System aus physischem Objekt, virtueller Repräsentation und bidirektionalem Datenfluss. Genau diese Logik beginnt sich vom industriellen Großsystem in kleinere, browserbasierte Kontexte zu übertragen. [3]

Kosten verschwinden dabei nicht. Sie verändern ihre Zusammensetzung. Während physische Infrastruktur relativ an Bedeutung verlieren kann, gewinnen Modellarchitektur, Rechenleistung und Iterationsgeschwindigkeit an Gewicht. Wettbewerb entsteht weniger durch Zugang zu Laborfläche oder Maschinenpark, sondern durch die Fähigkeit, digitale Modelle präzise zu formulieren und systematisch weiterzuentwickeln.

Der Browser wird damit vom Anzeigeinstrument zur operativen Plattform. Und genau hier beginnt eine neue Phase des Engineerings, die im folgenden Kapitel greifbar gemacht wird.

Vom Labor zur Browser Architektur, wie sich der Entwicklungsengpass verschiebt

Frühe Entwicklungsphasen scheitern selten an der Idee, sondern an der praktischen Hürde, sie schnell genug zu prüfen. Wer eine Hypothese testen will, muss aufbauen, verkabeln, messen, umbauen und erneut messen. Diese Routine ist wertvoll, aber sie kostet Zeit, bindet Ressourcen und macht Iteration teuer.

Browserbasierte Simulation verschiebt genau diesen Engpass. Nicht, weil sie die physische Realität ersetzt, sondern weil sie den Moment der Validierung vorzieht. Was bisher erst nach dem Aufbau überprüfbar war, kann heute bereits in einer digitalen Ausführungsschicht geprüft werden. Der eigentliche Gewinn entsteht in der Anzahl sinnvoller Iterationen pro Arbeitstag.

- Früher Engpass, Aufbauzeit und Materialverfügbarkeit bestimmen das Iterationstempo

- Neuer Engpass, Modellqualität und Simulationsperformance bestimmen die Aussagekraft

- Neue Routine, Variantenvergleich wird zum Standard statt zur Ausnahme

Digitaler Prüfstand im Browser, links die Simulation, rechts der reale Aufbau als Abgleich

Motiv: Redaktionelles Demonstrationsbild | Konzept: Vergleich zwischen browserbasierter Echtzeitsimulation und physischem Breadboard Aufbau | Visualisierung: © Ulrich Buckenlei | Visoric GmbH | Die Darstellung dient der analytischen Einordnung

Das Bild macht die Kernidee sichtbar. Auf dem Laptop läuft im Browser eine interaktive Schaltungssimulation. Das Breadboard, die Verbindungskabel, die Bauteile und die kleine Motor Einheit sind digital modelliert. Der sichtbare Cursor signalisiert aktive Interaktion. Parameter werden verändert, Verbindungen geprüft, Zustände in Echtzeit ausgewertet.

Rechts daneben steht derselbe Aufbau physisch auf dem Tisch. Kabel, Bauteile und Motor sind real vorhanden. Dieses Nebeneinander zeigt, worum es geht. Die Simulation ist keine Illustration, sondern ein funktionaler Prüfstand, der sich am realen Verhalten spiegeln lässt. Hier wird der Browser zur Entwicklungsumgebung.

Sobald Simulation als webbasierte Runtime verfügbar wird, verschiebt sich die Hürde von Installation und Infrastruktur hin zu Performance, Interoperabilität und sauberer Modellierung. [1]

Im nächsten Kapitel wird deshalb analysiert, unter welchen Bedingungen diese Verschiebung nicht nur technisch möglich, sondern auch ökonomisch sinnvoll ist.

Die Ökonomie der Iteration, warum Simulation Kostenstrukturen verändert

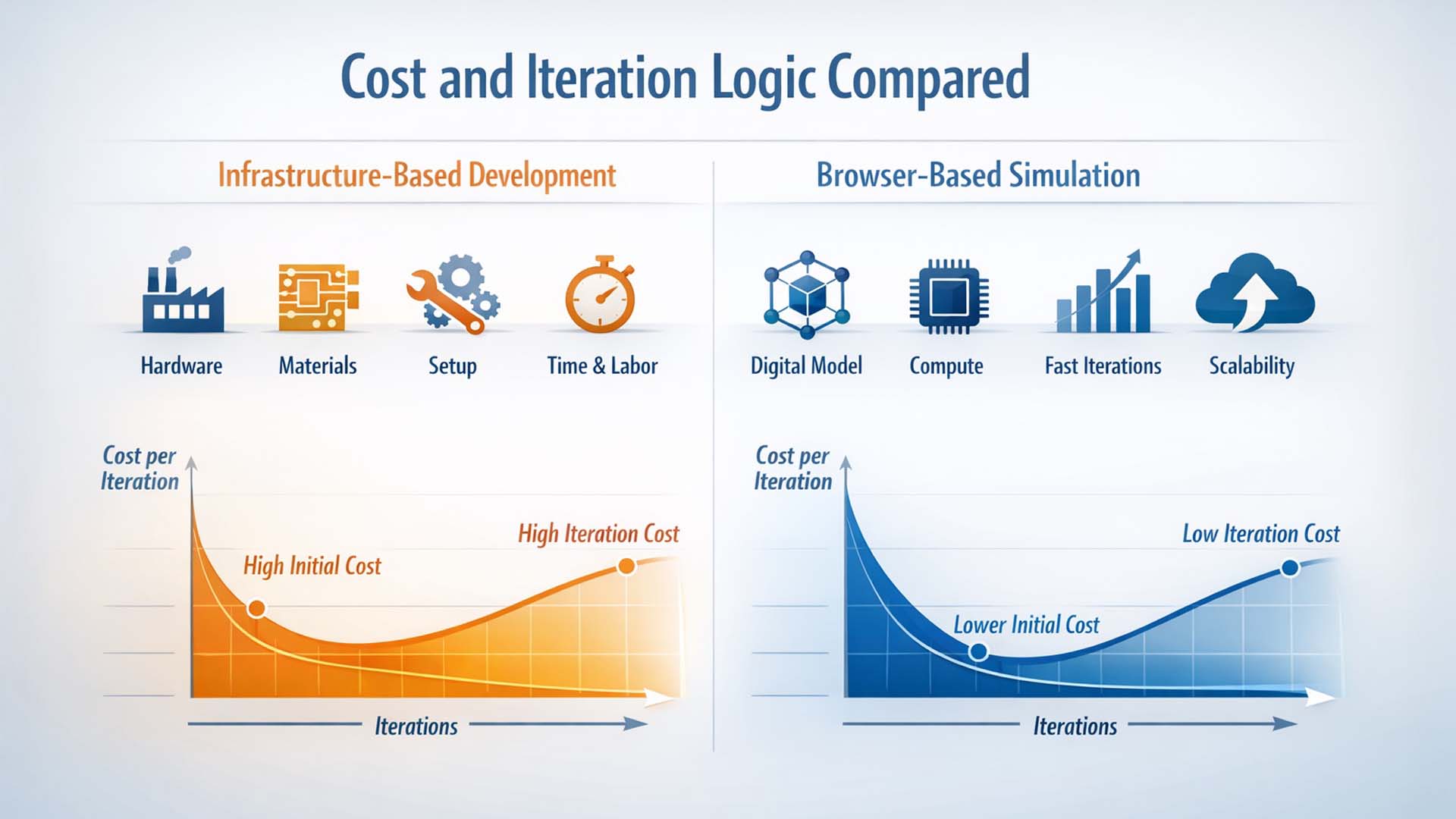

Im ersten Kapitel wurde sichtbar, wie sich der Ort der Validierung verschiebt. Digitale Zwillinge ermöglichen es, Entwicklungsentscheidungen früher datenbasiert zu treffen..[7] Im zweiten Kapitel geht es um die ökonomische Konsequenz dieser Verschiebung. Entwicklung ist nicht nur ein technischer Prozess, sondern eine Kostenarchitektur.

Analysen zur Wirtschaftlichkeit digitaler Zwillinge zeigen, dass insbesondere Iterationskosten, Fehlervermeidung und Risikoreduktion zentrale Effekte darstellen.[4] Genau hier entsteht der strukturelle Unterschied zwischen physischer Infrastruktur und browserbasierter Simulation.

- Infrastrukturgebundene Entwicklung ist stark von Hardware, Material und Aufbau abhängig

- Browserbasierte Simulation verlagert Kosten in Modellierung und Rechenleistung

- Der wirtschaftliche Vorteil entsteht durch sinkende Kosten pro Iteration

Cost and Iteration Logic Compared, struktureller Vergleich zwischen Infrastruktur basierter Entwicklung und browserbasierter Simulation

Grafik: Redaktionelle Analyse | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Die rechte Seite der Grafik zeigt mehr als nur eine alternative Kostenkurve. Sie visualisiert eine strukturelle Verschiebung. Während in der linken Hälfte jeder zusätzliche Test unmittelbar Material, Aufbauzeit und Personal bindet, entstehen Iterationen auf der rechten Seite primär durch Parameteränderung und Rechenleistung. Der entscheidende Unterschied liegt nicht im Wegfall von Kosten, sondern in ihrer Entkopplung von physischer Infrastruktur.

Webbasierte Digital-Twin-Frameworks belegen, dass Iterationszyklen softwareseitig skaliert werden können, ohne dass Laborfläche, Geräte oder Bauteile proportional mitwachsen müssen.[9] Sobald das Modell konsistent definiert ist, entstehen zusätzliche Varianten durch Berechnung statt durch Umbau.

GPU-beschleunigte Webtechnologien wie WebGPU verschieben dabei die Leistungsgrenze des Browsers selbst. Komplexe physikalische Zustände, Signalverläufe oder dreidimensionale Szenarien lassen sich in Echtzeit berechnen und visualisieren, ohne auf lokale Spezialsoftware angewiesen zu sein.[1][5]

Die ökonomische Konsequenz ist subtil, aber tiefgreifend. Validierung wird vorgezogen. Fehler werden früher sichtbar. Entscheidungsoptionen werden vergleichbar. Studien zur Wirtschaftlichkeit digitaler Zwillinge zeigen, dass genau diese Vorverlagerung von Tests zu signifikanten Effizienzgewinnen und Risikoreduktion führen kann.[4]

Diese Entwicklung bedeutet keine Abschaffung physischer Entwicklung. Sie verändert ihren Takt. Reale Prototypen entstehen später, aber fundierter. Unternehmen, die mehr valide Iterationen pro Zeiteinheit durchführen können, reduzieren Fehlversuche, verkürzen Lernzyklen und treffen präzisere Investitionsentscheidungen.

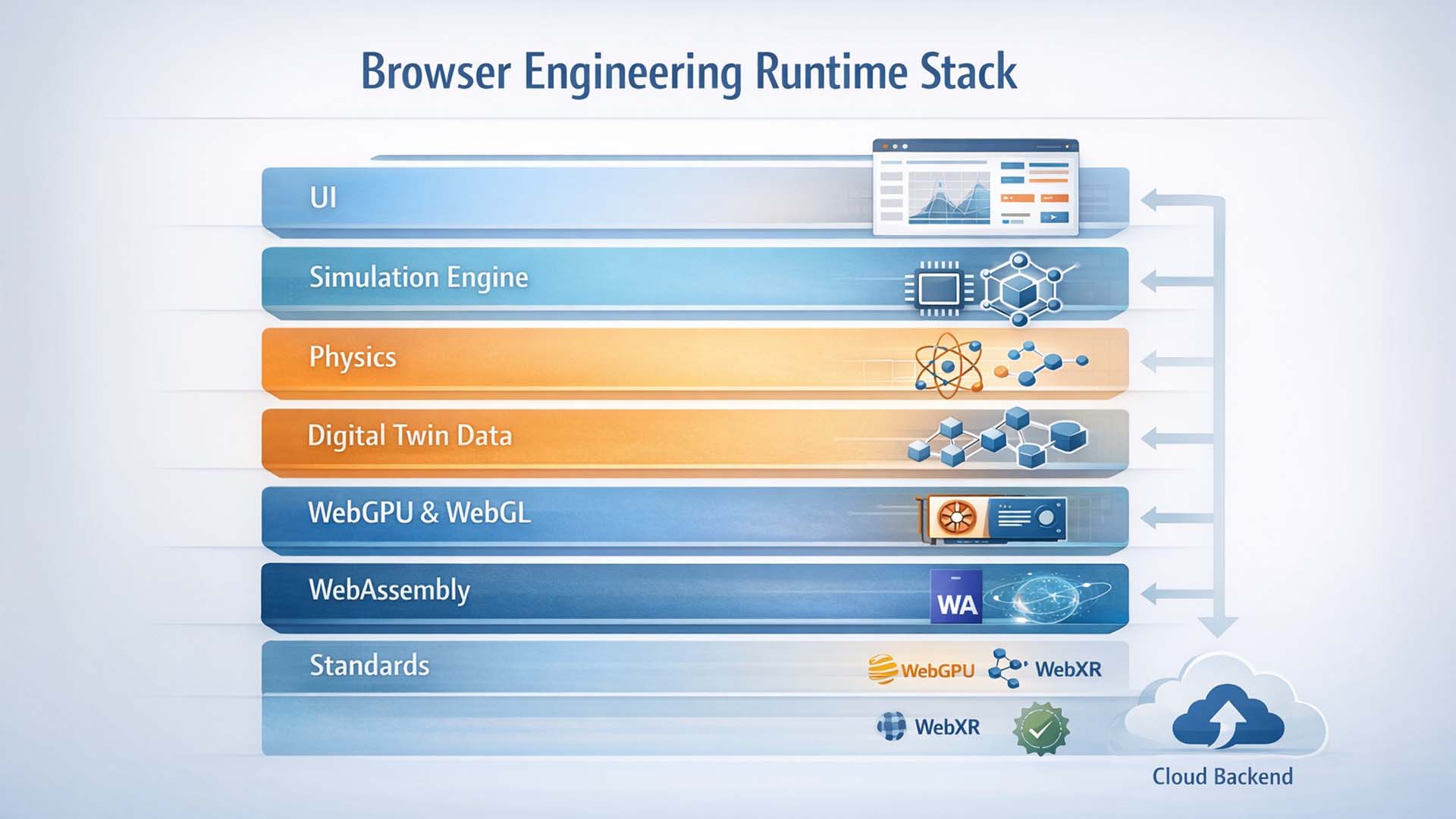

Die Architektur dahinter, wie der Browser zur Engineering Runtime wird

Wenn der Browser zur Entwicklungsumgebung wird, entsteht keine vereinfachte Weboberfläche, sondern eine vollständige Ausführungsschicht. Der Unterschied ist entscheidend. Eine Runtime ist nicht nur ein Ort zur Darstellung von Ergebnissen, sondern ein Ort, an dem Berechnung, Logik und Visualisierung gleichzeitig stattfinden.

Diese Transformation wird durch das Zusammenspiel standardisierter Webtechnologien möglich. WebGPU stellt eine moderne GPU- und Compute-Schnittstelle bereit, die parallele Shader-Programme und numerische Berechnungen direkt im Browser ausführen kann.[1] Damit verschiebt sich Rechenleistung von lokalen Spezialinstallationen in eine browserbasierte, skalierbare Umgebung.

Doch Rechenleistung allein macht noch keine Engineering Plattform. Erst durch die Kombination aus Interaktion, Simulationslogik und physikalischer Konsistenz entsteht eine operative Architektur.

- Benutzeroberfläche als Interaktionsschicht → Parameter, Varianten und Zustände werden steuerbar

- Simulation Engine als operativer Kern → Zustände werden berechnet, Abhängigkeiten aufgelöst

- Physik- und Digital-Twin-Logik als Validierungsebene → Modelle verhalten sich konsistent zur realen Welt[3]

Diese Schichten wirken nicht isoliert, sondern synchron. Ein Parameter wird verändert, die Simulation berechnet neue Zustände, die Physik reagiert, die Visualisierung aktualisiert sich in Echtzeit. Genau in dieser Synchronität liegt der Unterschied zwischen einer animierten Oberfläche und einer Engineering Runtime.

Damit entsteht eine neue Entwicklungsumgebung, die weder klassische Desktopsoftware noch reines Frontend ist. Sie ist eine integrierte Ausführungsschicht auf Basis offener Standards. Und genau deshalb ist sie langfristig skalierbar, interoperabel und industriell anschlussfähig.[8]

Browser Engineering Runtime Stack, Schichtenmodell einer webbasierten Simulationsarchitektur

Grafik: Redaktionelle Systemdarstellung | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Die Grafik zeigt keinen technischen Baukasten, sondern eine operative Architektur. Jede Schicht erfüllt eine klar definierte Funktion innerhalb einer webbasierten Engineering Runtime. Ganz oben liegt die Benutzeroberfläche. Hier interagiert der Entwickler mit dem System, verändert Parameter, startet Simulationen und bewertet Ergebnisse. Diese Ebene ist sichtbar, aber sie ist nur die Spitze des Systems.

Darunter arbeitet die Simulation Engine. Sie verarbeitet Zustände, berechnet Abhängigkeiten und orchestriert den Ablauf der Modellwelt. In dieser Schicht entscheidet sich, ob ein System lediglich animiert wird oder ob es sich konsistent verhält.

Die Physics Ebene sorgt dafür, dass Bewegungen, Kräfte, Signalzustände oder elektrische Prozesse nicht symbolisch dargestellt, sondern physikalisch berechnet werden. WebAssembly ermöglicht dabei nahezu native Rechenperformance direkt im Browser, wodurch komplexe Simulationslogik ausführbar wird.[6]

Die Digital Twin Data Ebene verbindet das Modell mit realen Parametern. Hier entstehen Zustandsmodelle, Versionslogik und Datenflüsse, die der Definition digitaler Zwillinge gemäß ISO 23247 entsprechen.[3] Das Modell ist nicht isoliert, sondern potenziell mit realen Maschinen oder Sensordaten verknüpft.

Darunter liegen WebGPU und moderne Rendering-Pipelines. Sie stellen sicher, dass dreidimensionale Szenen, Zustandsänderungen und visuelle Rückmeldungen in Echtzeit berechnet und dargestellt werden können.[1] Frameworks wie Three.js zeigen, wie diese Rendering-Schicht strukturiert integriert wird.[15]

Die unterste Ebene besteht aus Standards und Cloud-Anbindung. Hier wird Skalierbarkeit möglich. Offene Schnittstellen, Interoperabilität und Industrie-4.0-Rahmenwerke sichern langfristige Anschlussfähigkeit.[8]

Was diese Grafik verdeutlicht, ist ein Paradigmenwechsel. Der Browser wird nicht mehr als Anzeigeinstrument verstanden, sondern als Ausführungsschicht. Rendering, Physik, Logik und Datenmodell laufen in einer integrierten Runtime. Genau diese Konvergenz macht es möglich, dass das Labor nicht nur visualisiert, sondern funktional in den Browser erweitert wird.

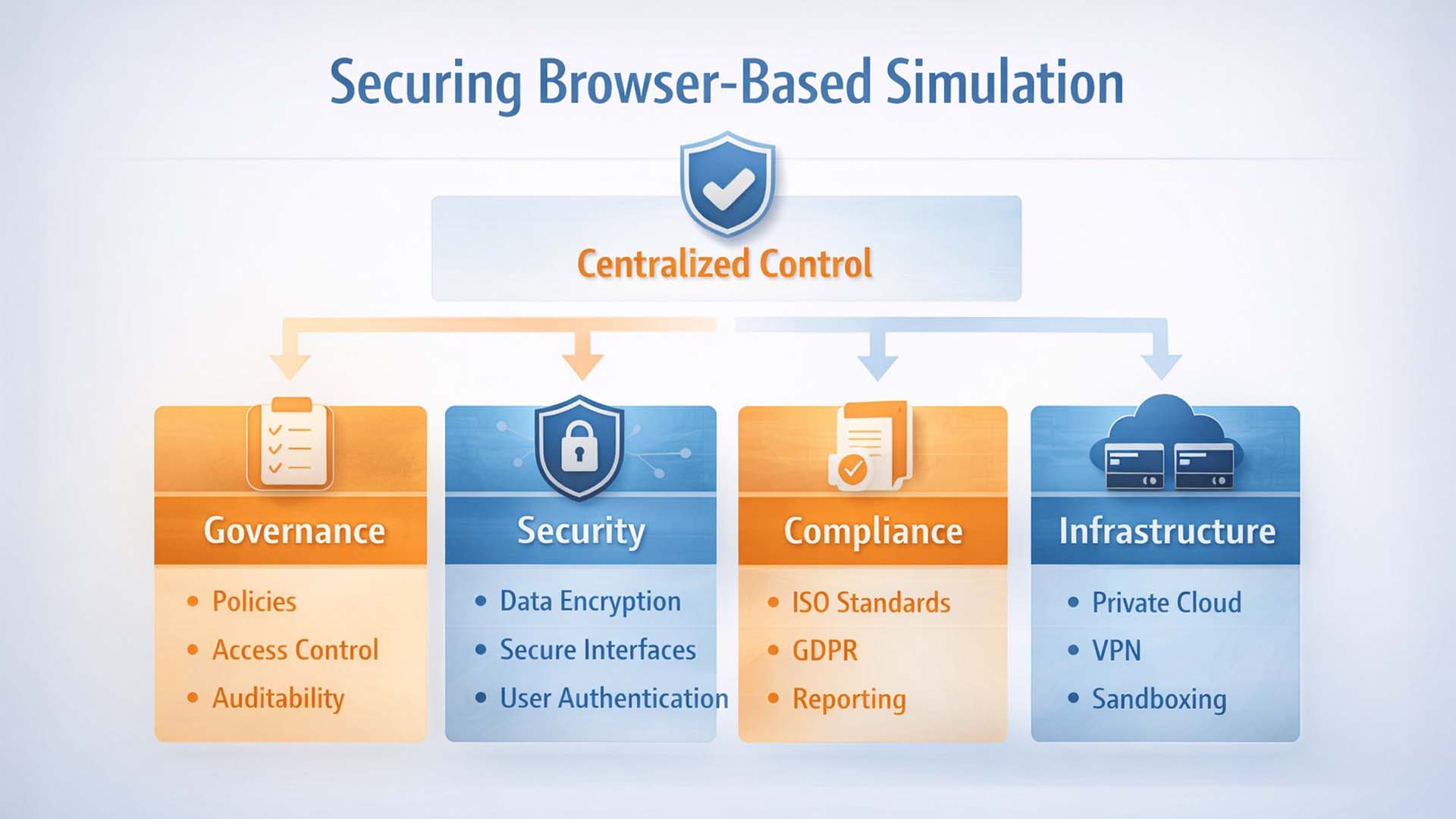

Governance und Sicherheit, wenn das Labor zur vernetzten Plattform wird

Sobald digitale Zwillinge reale Systeme repräsentieren, verändert sich nicht nur die Technik, sondern die Verantwortung. Eine browserbasierte Simulationsumgebung ist kein isoliertes Werkzeug mehr, sondern Teil einer vernetzten Plattformarchitektur. Modelle können reale Produktionsparameter abbilden. Simulationen können Investitionsentscheidungen beeinflussen. Varianten können in Serienprozesse einfließen. Genau hier entstehen organisatorische und regulatorische Anforderungen.

ISO 23247 beschreibt digitale Zwillinge nicht als bloße Visualisierung, sondern als integriertes System aus physischem Objekt, virtueller Repräsentation und Datenfluss.[3] Sobald dieser Datenfluss bidirektional wird, wird Governance zur infrastrukturellen Notwendigkeit.

- Governance als strukturierender Rahmen → Versionierung, Rollenmodelle, Nachvollziehbarkeit von Modelländerungen

- Security als integraler Bestandteil → Verschlüsselung, Zugriffskontrolle und abgesicherte Schnittstellen sind Voraussetzung für industrielle Nutzung

- Compliance als strategische Absicherung → Normen, Dokumentationspflichten und Auditierbarkeit sichern langfristige Einsatzfähigkeit

Securing Browser-Based Simulation, Governance- und Sicherheitsarchitektur für browserbasierte Engineering Plattformen

Grafik: Redaktionelle Systemdarstellung | Visualisierung: © Ulrich Buckenlei | Visoric GmbH

Die Grafik ist bewusst als Schichtenmodell mit zentraler Steuerung aufgebaut. Im Zentrum steht „Centralized Control“. Diese Ebene symbolisiert keine Überwachung, sondern Orchestrierung. Rollen, Berechtigungen und Freigabeprozesse werden strukturiert verwaltet.

Darunter sind vier Funktionsblöcke angeordnet. „Governance“ steht für Richtlinien, Versionslogik und Auditability. Jede Modelländerung muss nachvollziehbar bleiben. „Security“ adressiert Verschlüsselung, sichere APIs und Authentifizierung. Gerade wenn reale Produktionsdaten oder proprietäre Designs abgebildet werden, ist Datensicherheit nicht optional. „Compliance“ verweist auf ISO-Standards, Datenschutz und regulatorische Dokumentationspflichten. „Infrastructure“ schließlich beschreibt die technische Basis aus Cloud-Architektur, VPN-Strukturen und isolierten Ausführungsumgebungen.

Industrie-4.0-Rahmenwerke betonen, dass Interoperabilität und standardisierte Integration Grundvoraussetzungen für nachhaltige Implementierung sind.[8] Studien zur Wirtschaftlichkeit digitaler Zwillinge zeigen zudem, dass fehlende Governance-Strukturen langfristig höhere Risiken und Kosten verursachen können als die Technologie selbst.[4]

Die zentrale Erkenntnis dieses Kapitels lautet daher: Wenn das Labor in den Browser wandert, wird es nicht informeller, sondern strukturierter. Verantwortung verschiebt sich von physischen Räumen in digitale Architekturen. Sicherheit, Transparenz und organisatorische Klarheit entscheiden darüber, ob browserbasierte Simulation ein Experiment bleibt oder zur industriellen Plattform wird.

Damit ist die technische und regulatorische Grundlage beschrieben. Im nächsten Kapitel wird analysiert, welche strategischen Konsequenzen sich daraus für Innovationsgeschwindigkeit, Wettbewerbsdynamik und Geschäftsmodelle ergeben.

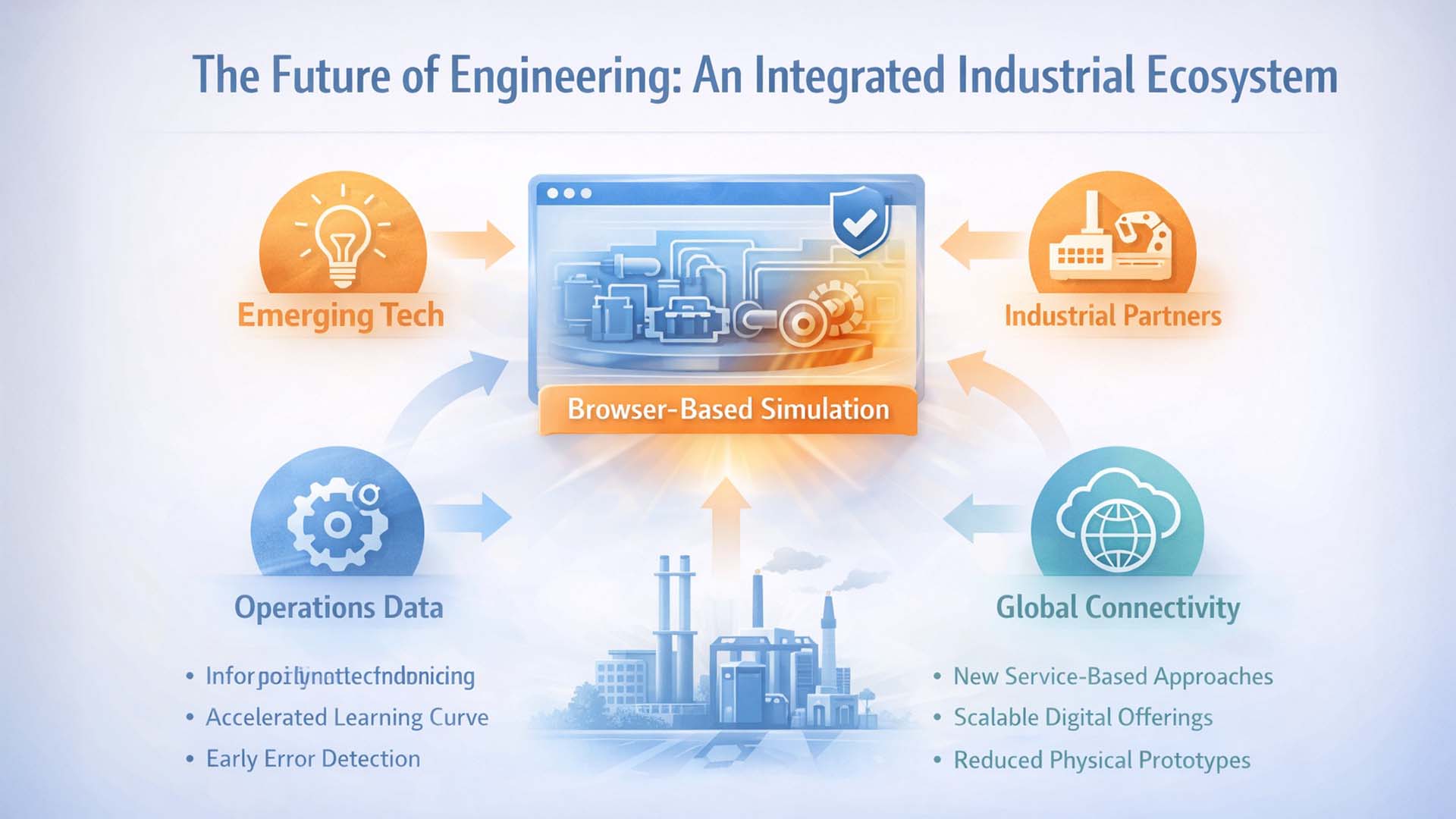

Strategische Auswirkungen, wenn Simulation zur Infrastruktur wird

Mit der technischen Architektur und der Governance-Struktur ist der Rahmen beschrieben. Die entscheidende Frage ist nun strategischer Natur. Was verändert sich für Unternehmen, wenn browserbasierte Simulation nicht nur ein Werkzeug, sondern eine infrastrukturelle Grundlage der Entwicklung wird.

Digitale Zwillinge gelten heute als zentrales Element moderner Produktions- und Innovationssysteme. Ihre wirtschaftliche Relevanz liegt weniger im Einzelprojekt als in der langfristigen Beschleunigung von Lernzyklen und Entscheidungsprozessen.[4]

- Innovationsgeschwindigkeit wird zum Wettbewerbsfaktor

- Produktentscheidungen werden datenbasiert vorgezogen

- Digitale Services ergänzen physische Produkte

Strategic Impact of Browser-Based Simulation, Wechselwirkung zwischen Innovationsgeschwindigkeit, Wettbewerbsposition und Geschäftsmodellen

Grafik: Redaktionelle Strategiedarstellung | Visualisierung: © Ulrich Buckenlei | Visoric GmbH | Beschriftungen in Englisch zur internationalen Einordnung

Im Zentrum der Grafik steht „Innovation“. Sie wird als Zahnrad mit integrierter Glühbirne dargestellt und symbolisiert die zentrale Wirkung browserbasierter Simulation. Innovation ist hier nicht als isolierter Kreativakt gemeint, sondern als Ergebnis systematischer Iteration.

Links ist „R&D Speed“ positioniert. Die dargestellten Punkte „More Iterations per Time“, „Accelerated Learning Curve“ und „Early Error Detection“ verdeutlichen, dass Geschwindigkeit aus der Anzahl valider Iterationen entsteht. Browserbasierte Simulation erhöht diese Iterationsdichte und verschiebt damit die Lernkurve eines Unternehmens.

Rechts ist „Competitive Position“ dargestellt. Schnellere Validierung ermöglicht klügere Produktentscheidungen, reduziert Time to Market und stärkt die Wertpositionierung. Wettbewerbsvorteile entstehen dadurch nicht nur durch Produktqualität, sondern durch strukturelle Entscheidungsfähigkeit.

Unten ist „Business Models“ verankert. Die Punkte „New Service-Based Approaches“, „Scalable Digital Offerings“ und „Reduced Physical Prototypes“ zeigen, dass Simulation nicht nur Entwicklungsprozesse verändert, sondern Angebotsstrukturen. Digitale Zwillinge und browserbasierte Plattformen erlauben serviceorientierte Erweiterungen, Remote-Validierung und neue Erlösmodelle.[8]

Die Zahnräder sind bewusst miteinander verbunden. Geschwindigkeit beeinflusst Wettbewerbsfähigkeit. Wettbewerbsfähigkeit beeinflusst Geschäftsmodelle. Geschäftsmodelle bestimmen wiederum Investitionsspielräume für Innovation. Es entsteht ein strategischer Kreislauf.

Studien zu webbasierten Digital-Twin-Frameworks zeigen, dass clientfreie Bereitstellung und zentrale Plattformarchitektur Skalierungseffekte erzeugen, die weit über Einzelprojekte hinausgehen.[9] Genau hier wird Simulation zur Infrastruktur.

Die zentrale Erkenntnis dieses Kapitels lautet daher nicht, dass der Browser ein neues Tool ist. Er wird zu einer operativen Schicht innerhalb der Wertschöpfung. Unternehmen, die diese Schicht strategisch integrieren, erhöhen ihre Innovationsfrequenz, verkürzen Entscheidungszyklen und erweitern ihre Geschäftslogik.

Damit schließt sich der Bogen des Artikels. Vom physischen Labor über die ökonomische Verschiebung, die technische Architektur und Governance-Struktur bis hin zur strategischen Dimension wird sichtbar, dass sich Engineering nicht auflöst, sondern neu organisiert.

Im abschließenden Abschnitt wird die Gesamtentwicklung noch einmal verdichtet zusammengefasst und in einen übergeordneten industriellen Kontext eingeordnet.

Vom Strategiebild zur realen Anwendung, das Labor im Browser in Aktion

Nach der strategischen Einordnung wird die abstrakte Argumentation nun konkret. Das folgende Kapitel zeigt nicht mehr nur Architektur, Governance oder Marktlogik. Es zeigt Anwendung. Eine reale browserbasierte Simulationsumgebung, in der physische Logik, Code und Visualisierung in Echtzeit zusammenwirken.

- Browser als operative Engineering Umgebung

- Digitale Repräsentation physischer Bauteile

- Echtzeit Synchronisation von Logik, Physik und Visualisierung

Browserbasierte Echtzeitsimulation einer elektronischen Schaltung mit digitalem Motor als synchronisierte Visualisierung

Demonstrationsumgebung: Webbasierte Schaltungssimulation | Motiv: Interaktives Breadboard mit analoger Logik und 3D Visualisierung | Redaktionelle Einordnung

Die Szene zeigt eine interaktive Schaltungssimulation im Browser. Links ist die Bauteilbibliothek sichtbar, aus der Komponenten wie LED, Motor, 555 Timer, Transistoren oder Breadboard ausgewählt werden können. In der Mitte befindet sich der digitale Aufbau mit Widerständen, Kondensatoren, Transistoren und einer Spannungsquelle. Rechts ist die dreidimensionale Visualisierung eines Motors eingebettet, der durch die simulierte Logik angesteuert wird.

Entscheidend ist die Gleichzeitigkeit der Ebenen. Analoge Bauteile werden nicht nur grafisch dargestellt. Ihre elektrischen Eigenschaften werden berechnet. Signalverläufe entstehen in Echtzeit. Der Motor rotiert nicht als Animation, sondern als visualisierte Folge berechneter Zustände.

Das System zeigt damit exemplarisch, wie sich ein digitaler Zwilling im Browser verhält. Es handelt sich nicht um ein statisches Modell. Es ist ein interaktives System, in dem Code, Physik und Visualisierung synchronisiert sind. Webtechnologien wie GPU Beschleunigung und performante Simulationskerne ermöglichen diese Ausführung direkt in der Runtime des Browsers.[1]

Solche Plattformen existieren bereits in unterschiedlichen Ausprägungen, von webbasierten Schaltungssimulatoren bis zu komplexeren Engineering Frameworks.[11] Entscheidend ist nicht das einzelne Tool, sondern das Prinzip. Der Browser wird zur Ausführungsschicht für reale Logik.

Damit schließt sich der Kreis zur strategischen Perspektive. Was zuvor als Infrastruktur beschrieben wurde, wird hier greifbar. Die Simulation ersetzt nicht das physische Labor. Sie erweitert es um eine programmierbare, skalierbare Ebene.

Im folgenden Abschnitt wird diese Entwicklung noch einmal verdichtet zusammengeführt. Das abschließende Videokapitel fasst die Kernaussage in komprimierter Form zusammen und überführt die Analyse in eine klare Vision.

Videoanalyse – Wenn das physische Labor in den Browser wandert

Das folgende Video zeigt keine Vision, sondern eine bereits funktionsfähige Entwicklungsumgebung. Eine elektronische Schaltung wird vollständig im Browser aufgebaut, konfiguriert und in Echtzeit ausgeführt. Bauteile werden per Mausklick platziert, Signale berechnet und physikalische Zustände synchron visualisiert.

Was hier sichtbar wird, ist mehr als eine grafische Simulation. Analoge Komponenten werden mathematisch modelliert, Signalverläufe dynamisch berechnet und dreidimensionale Objekte in Echtzeit mit der zugrunde liegenden Logik synchronisiert. Rendering, Physik und ausführbarer Code laufen in derselben Webumgebung zusammen.[1]

Damit verschiebt sich der Ort der frühen Validierung. Tests, die früher einen physischen Aufbau erforderten, können nun im Browser geprüft werden. Das bedeutet nicht den Ersatz des Labors, sondern seine Erweiterung. Digitale Zwillinge beginnen hier nicht als abstrakte Industriearchitektur, sondern als operative Entwicklungsumgebung.[3]

Die strategische Relevanz liegt in der Iterationsfähigkeit. Wenn Simulation, Codeausführung und Visualisierung unmittelbar gekoppelt sind, entsteht eine neue Engineering-Routine. Varianten lassen sich schneller prüfen, Fehler früher erkennen und Optimierungen datenbasiert durchführen. KI kann in diesem Kontext zur Analyse, Debugging-Unterstützung und Signaloptimierung beitragen.[4]

Web Native Simulation – Interaktive Schaltungssimulation mit synchronisierter 3D Visualisierung im Browser

Demonstrationsumgebung: Browserbasierte Echtzeitsimulation elektronischer Schaltungen |

Analytische Einordnung: Ulrich Buckenlei

Dieses Beispiel steht exemplarisch für den Übergang von hardwaregebundener Validierung hin zu modellbasierter Iteration im Web. Es markiert nicht das Ende physischer Entwicklung, sondern den Beginn einer programmierbaren, intelligenten Infrastruktur, in der sich Labor, Code und KI zunehmend überlagern.

Im abschließenden Kapitel wird diese Entwicklung noch einmal verdichtet zusammengeführt und in einen übergeordneten industriellen Kontext eingeordnet.

Quellen und Referenzen

- W3C, „WebGPU Specification“, Editor’s Draft und technische Spezifikation, Zugriff 2024–2026. [1]

- Khronos Group, „WebGL und Echtzeit-Grafikstandards“, technische Dokumentation, Zugriff 2024–2026. [2]

- ISO, ISO 23247-1: Digital Twin Framework für die Fertigung, Teil 1: Überblick und allgemeine Prinzipien, International Organization for Standardization, 2021. [3]

- McKinsey & Company, Analysen zum wirtschaftlichen Potenzial von Digital Twins in Industrie und Produktion, 2023–2025. [4]

- Google Chrome Developers, Dokumentation zu WebGPU, browserbasierter Rechenleistung und Rendering-Pipelines, Zugriff 2024–2026. [5]

- WebAssembly Community Group, „WebAssembly Core Specifications und Implementierungsressourcen“, Zugriff 2024–2026. [6]

- Deloitte, Studien zu Digital Twins, simulationsbasierter Entwicklung und Effizienzsteigerungen in der Industrie, 2023–2025. [7]

- Plattform Industrie 4.0, Publikationen zu Interoperabilität, digitalen Industriearchitekturen und vernetzten Produktionssystemen, 2023–2025. [8]

- IEEE Access, Forschungsarbeiten zu webbasierten Digital-Twin-Systemen, Simulation und Echtzeit-Engineering-Plattformen, 2022–2025. [9]

- Fraunhofer-Gesellschaft, Angewandte Forschung zu Digital Twins, industrieller Simulation und Smart Manufacturing, 2023–2025. [10]

- Autodesk Research, Publikationen zu Simulations-Workflows, virtuellem Prototyping und Engineering-Validierung, 2022–2025. [11]

- Europäische Kommission, Strategiepapiere zur Digitalisierung, industriellen Datenräumen und fortschrittlicher Fertigung, 2023–2025. [12]

- ENISA, Leitlinien zur Cybersicherheit für vernetzte Industriesysteme und cloudbasierte Infrastrukturen, 2023–2025. [13]

- NIST, Veröffentlichungen zu Digital Engineering, modellbasierter Systementwicklung und vertrauenswürdigen Simulationsarchitekturen, 2022–2025. [14]

- Three.js Dokumentation, Rendering-Architektur und browserbasierte 3D-Implementierung, Zugriff 2024–2026. [15]

Wenn das reale Labor digital erweitert wird, braucht es mehr als ein Tool

Browserbasierte Simulation ist kein isoliertes Feature. Sie ist eine infrastrukturelle Entscheidung. Sobald physische Prozesse, Schaltungen, Maschinen oder ganze Produktionsketten als digitale Zwillinge im Web modelliert und validiert werden, verändern sich Entwicklungslogik, Verantwortlichkeiten und Investitionsentscheidungen.

Die zentrale Frage lautet dann nicht mehr, ob Simulation technisch möglich ist. Entscheidend ist, wie sie strategisch eingebettet wird. Welche Systeme sollen digital gespiegelt werden. Welche Datenquellen werden angebunden. Wie wird Performance, Sicherheit und Governance gewährleistet. Und wie entsteht daraus ein echter Mehrwert für Produktentwicklung, Service oder Betrieb.

Wer sein reales Labor in eine browserbasierte Engineering Umgebung überführen möchte, braucht mehr als einzelne Tools. Er braucht eine saubere End to End Architektur. Von der Analyse geeigneter Use Cases über die Konzeption der Simulationslogik, die Auswahl geeigneter Webtechnologien, den Aufbau performanter Digital Twins bis hin zur Integration realer Maschinen, Sensorik und Datenströme.

Genau an dieser Schnittstelle arbeitet das Visoric Expertenteam in München. Wir begleiten Unternehmen bei der strategischen Einordnung, konzipieren browserbasierte Simulationsumgebungen, entwickeln interaktive Engineering Plattformen und verbinden digitale Modelle mit realen Systemen. Nicht als Showcases, sondern als belastbare Infrastruktur.

Konzeptionsteam von VISORIC bei der Entwicklung browserbasierter Engineering- und Digital-Twin-Architekturen

Quelle: VISORIC GmbH | München

- Strategische Analyse → Identifikation relevanter Use Cases für browserbasierte Simulation

- Architektur und Konzeption → Design von Digital-Twin- und Web-Engineering-Stacks

- Proof of Concept → Validierung technischer und wirtschaftlicher Machbarkeit

- Realisierung → Entwicklung interaktiver Simulationsumgebungen im Browser

- Integration → Kopplung digitaler Modelle mit realen Maschinen und Datenquellen

- Skalierung → Governance, Security und performante Plattformarchitektur

Wenn Sie prüfen möchten, wie sich Ihr reales Labor, Ihre Maschinen oder Ihre Entwicklungsprozesse in eine skalierbare, webbasierte Simulationsumgebung überführen lassen, lohnt sich ein strukturiertes Gespräch.

Nicht als Verkaufspräsentation, sondern als gemeinsame Analyse, wo digitale Erweiterung echten strategischen Mehrwert schafft.

Kontaktpersonen:

Ulrich Buckenlei (Kreativdirektor)

Mobil: +49 152 53532871

E-Mail: ulrich.buckenlei@visoric.com

Nataliya Daniltseva (Projektleiterin)

Mobil: + 49 176 72805705

E-Mail: nataliya.daniltseva@visoric.com

Adresse:

VISORIC GmbH

Bayerstraße 13

D-80335 München