Impressionen vom Mobile World Congress 2026 in Barcelona

Foto: © Ulrich Buckenlei | Visoric GmbH

Während der Mobile World Congress 2026 in Barcelona noch läuft, zeichnet sich bereits eine klare Entwicklung ab. Intelligente Netze, Künstliche Intelligenz und Extended Reality wachsen zur tragenden Infrastruktur moderner Wertschöpfung zusammen.

In den Messehallen wird deutlich, dass es nicht mehr um einzelne Produkte geht. Sichtbar wird ein struktureller Wandel. Systeme werden so entwickelt, dass sie Situationen verstehen und unmittelbar handeln können. Intelligenz rückt näher an den Ort des Geschehens.

Von der Cloud Logik zur situativen Intelligenz am Netzrand

Über viele Jahre hinweg folgte die Digitalisierung einer klaren technischen Logik. Daten wurden lokal erfasst, anschließend in zentrale Rechenzentren übertragen und dort verarbeitet. Die eigentliche Intelligenz lag fast immer in großen Cloud-Infrastrukturen. Entscheidungen wurden berechnet und danach zurück an Maschinen, Systeme oder Anwendungen übertragen.

Dieses Modell funktionierte gut, solange Datenmengen überschaubar waren und Entscheidungen nicht in Echtzeit getroffen werden mussten. Mit dem rasanten Fortschritt der Künstlichen Intelligenz und der steigenden Anzahl vernetzter Geräte stößt diese Architektur jedoch zunehmend an ihre Grenzen.

Auf dem Mobile World Congress 2026 wird deshalb ein deutlicher Wandel sichtbar. Immer mehr Rechenleistung wandert näher an den Ort, an dem Daten entstehen. Systeme werden so konzipiert, dass sie Situationen unmittelbar analysieren und Entscheidungen direkt vor Ort treffen können.

Der technische Hintergrund ist klar: Modelle werden effizienter, Hardware leistungsfähiger und Netzinfrastrukturen stabiler. Dadurch entstehen neue Möglichkeiten, Intelligenz nicht nur zentral, sondern verteilt im gesamten System zu betreiben.

- Systeme gewinnen Kontext und Situationsverständnis

- Entscheidungen erfolgen unmittelbar am Entstehungsort

- Abhängigkeiten von zentraler Infrastruktur werden reduziert

AI Data Center Infrastruktur auf dem Mobile World Congress 2026 in Barcelona

Foto: © Ulrich Buckenlei | Visoric GmbH

Die Demonstration solcher Systeme ist auf dem Mobile World Congress an vielen Ständen zu sehen. Hersteller präsentieren komplette AI-Infrastrukturen, die speziell für den Betrieb moderner KI-Anwendungen entwickelt wurden. Dabei geht es nicht nur um reine Rechenleistung, sondern um ein Zusammenspiel aus spezialisierten Prozessoren, Hochgeschwindigkeitsnetzwerken, energieeffizienter Kühlung und optimierter Softwarearchitektur.

Solche Systeme bilden die Grundlage für eine neue Generation intelligenter Anwendungen. Produktionsanlagen können Prozesse in Echtzeit überwachen, Logistiksysteme reagieren dynamisch auf Veränderungen und technische Infrastrukturen passen sich automatisch an neue Situationen an.

Der Wandel betrifft damit nicht nur einzelne Technologien, sondern die gesamte Architektur digitaler Systeme. Intelligenz wird zu einer verteilten Fähigkeit, die dort verfügbar ist, wo sie benötigt wird. Genau diese Entwicklung prägt viele der Innovationen, die auf dem Mobile World Congress 2026 vorgestellt werden.

Embodied AI als neues Entwicklungsparadigma

Ein Begriff prägt viele Gespräche auf dem Mobile World Congress 2026 besonders deutlich: Embodied AI. Gemeint sind Systeme, die ihre Umgebung wahrnehmen, interpretieren und eigenständig handeln können. Intelligenz bleibt dabei nicht abstrakt in Softwaremodellen verborgen, sondern wird in physische Systeme integriert, die mit der realen Welt interagieren.

Während klassische Künstliche Intelligenz vor allem Daten analysierte, erweitert Embodied AI diese Fähigkeit um Wahrnehmung und Handlung. Sensoren erfassen Situationen, Modelle interpretieren die Umgebung und mechanische oder digitale Systeme setzen Entscheidungen unmittelbar um. Intelligenz wird damit nicht nur berechnet, sondern sichtbar.

Gerade auf Technologiemessen wie dem Mobile World Congress lässt sich dieser Wandel besonders anschaulich beobachten. Humanoide Roboter, autonome Maschinen und intelligente Assistenzsysteme demonstrieren, wie KI zunehmend in physische Systeme integriert wird. Statt ausschließlich Daten zu verarbeiten, übernehmen solche Systeme konkrete Aufgaben.

- Lernprozesse werden kontinuierlich fortgeführt

- Reale und ergänzende Trainingsdaten werden kombiniert

- Modelle verbessern sich direkt im Einsatz

Humanoider Roboter demonstriert Kalligrafie auf einem Partnerstand während des Mobile World Congress 2026

Foto: © Ulrich Buckenlei | Visoric GmbH

Die Demonstration solcher Fähigkeiten verdeutlicht den grundlegenden Unterschied zu früheren KI-Systemen. Während viele Anwendungen bislang im Hintergrund arbeiteten, tritt Embodied AI sichtbar in Erscheinung. Maschinen können Objekte greifen, Werkzeuge benutzen oder – wie in dieser Demonstration – präzise Bewegungsabläufe ausführen.

Technisch basiert diese Entwicklung auf einer Kombination aus Sensorik, Robotik und leistungsfähigen KI-Modellen. Kameras erfassen die Umgebung, neuronale Netze interpretieren visuelle Informationen und Steuerungssysteme setzen diese Erkenntnisse in Bewegungen um. Dadurch entstehen Systeme, die nicht nur analysieren, sondern handeln können.

Für Unternehmen bedeutet das einen grundlegenden Perspektivwechsel. Künstliche Intelligenz wird nicht länger nur als Softwarelösung betrachtet, sondern als Teil einer neuen technischen Infrastruktur. Wahrnehmung, Analyse und Handlung werden in einem System miteinander verbunden.

Der Mobile World Congress 2026 zeigt damit deutlich, dass sich KI von einem reinen Analysewerkzeug zu einer operativen Technologie entwickelt. Embodied AI wird in Zukunft eine zentrale Rolle spielen – in Robotik, industrieller Automatisierung, Logistik und vielen weiteren Bereichen, in denen intelligente Systeme direkt mit der physischen Welt interagieren.

Verteiltes Lernen als Grundlage skalierbarer Systeme

Ein zentraler Baustein dieser Entwicklung ist verteiltes Lernen. Erkenntnisse werden lokal gewonnen, ohne dass sämtliche Rohdaten an zentrale Systeme übertragen werden müssen. Dadurch lassen sich sensible Daten schützen und gleichzeitig gemeinsame Verbesserungen erzielen.

Gerade in regulierten Branchen oder in Umgebungen mit begrenzter Netzabdeckung eröffnet dieser Ansatz neue Möglichkeiten. Maschinen, Sensoren und Produktionssysteme können Daten vor Ort analysieren und daraus lernen, während nur ausgewählte Erkenntnisse oder Modellanpassungen weitergegeben werden. Auf diese Weise entsteht ein Netzwerk intelligenter Systeme, das gemeinsam besser wird, ohne die Kontrolle über Daten zu verlieren.

- Wissen wird geteilt, Daten bleiben häufig vor Ort

- Skalierung gelingt auch bei sensiblen Anwendungen

- Systeme werden robuster gegenüber Störungen

Industrielle Plattformen für Digital Twins und Robot Training auf dem Mobile World Congress 2026

Foto: © Ulrich Buckenlei | Visoric GmbH

Auf dem Mobile World Congress 2026 lassen sich solche Konzepte an vielen Ständen beobachten. Hersteller zeigen Plattformen, auf denen industrielle Anwendungen trainiert, simuliert und anschließend in reale Systeme übertragen werden können. Besonders häufig fällt dabei der Begriff des digitalen Zwillings.

Digitale Zwillinge ermöglichen es, komplexe Maschinen oder ganze Produktionslinien virtuell abzubilden. In dieser simulierten Umgebung können Modelle trainiert, Fehler analysiert und neue Abläufe getestet werden, bevor sie in der realen Welt eingesetzt werden. Das reduziert Risiken und beschleunigt die Entwicklung neuer Anwendungen erheblich.

Im Zusammenspiel mit verteilten Lernmethoden entsteht daraus eine leistungsfähige Infrastruktur. Systeme lernen lokal aus ihren Erfahrungen, während übergreifende Plattformen neue Erkenntnisse zusammenführen und weiterentwickeln. So lassen sich Roboter, Produktionssysteme oder autonome Geräte kontinuierlich verbessern, ohne jedes System einzeln neu trainieren zu müssen.

Genau diese Kombination aus lokaler Intelligenz und zentraler Koordination wird in den kommenden Jahren eine entscheidende Rolle spielen. Sie erlaubt es Unternehmen, KI nicht nur in einzelnen Anwendungen zu nutzen, sondern über ganze Infrastrukturen hinweg zu skalieren.

So entsteht Schritt für Schritt eine neue Form industrieller Intelligenz: verteilt, lernfähig und eng mit realen Prozessen verbunden.

Extended Reality als Schnittstelle intelligenter Systeme

Während künstliche Intelligenz zunehmend Entscheidungen trifft und Systeme autonomer werden, stellt sich eine zentrale Frage: Wie greifen Menschen auf diese komplexen digitalen Strukturen zu? Genau an dieser Stelle gewinnt Extended Reality eine neue Bedeutung.

XR-Technologien ermöglichen es, digitale Informationen direkt im räumlichen Kontext darzustellen. Daten, Simulationen oder Zustände von Maschinen werden nicht mehr ausschließlich auf klassischen Bildschirmen angezeigt, sondern dreidimensional im Raum visualisiert. Nutzer können digitale Modelle betrachten, verändern und mit ihnen interagieren, während sie gleichzeitig in ihrer realen Umgebung bleiben.

Diese Art der Darstellung verändert die Interaktion zwischen Mensch und digitaler Infrastruktur grundlegend. Komplexe Daten lassen sich intuitiver erfassen, Zusammenhänge werden schneller sichtbar und Entscheidungen können auf einer deutlich besseren Informationsbasis getroffen werden.

- Komplexe Daten werden räumlich visualisiert

- Digitale Zwillinge lassen sich direkt im Arbeitskontext erleben

- Mensch und KI arbeiten enger zusammen

Hands-on Demonstration des Samsung Galaxy XR Headsets (Project Moohan) auf dem Mobile World Congress 2026

Foto: © Ulrich Buckenlei | Visoric GmbH

Gerade im industriellen Umfeld eröffnen solche Technologien neue Möglichkeiten. Ingenieure können digitale Zwillinge von Maschinen analysieren, Wartungsschritte visualisieren oder Produktionsprozesse simulieren. Komplexe technische Systeme werden dadurch verständlicher und Entscheidungen lassen sich schneller treffen.

Auf dem Mobile World Congress 2026 wird außerdem sichtbar, dass sich neben Apple ein weiteres XR-Ökosystem entwickelt. Samsung und Google arbeiten gemeinsam an einer neuen Gerätegeneration, die auf der Plattform Android XR basiert. Das Samsung Galaxy XR Headset, intern unter dem Namen Project Moohan entwickelt, gehört zu den ersten Geräten dieser neuen Plattform.

Diese Geräte sollen künftig nicht nur für Unterhaltung genutzt werden, sondern auch für industrielle Anwendungen, Planung, Training und Zusammenarbeit. XR entwickelt sich damit zu einer Schnittstelle, über die Menschen mit komplexen digitalen Systemen interagieren können.

Während künstliche Intelligenz Daten analysiert und Prozesse optimiert, übersetzt Extended Reality diese Informationen in eine räumlich verständliche Form. Nutzer sehen nicht nur Daten, sondern erleben sie im Kontext ihrer Umgebung.

Damit wird XR zunehmend zu einer operativen Benutzeroberfläche für die nächste Generation digitaler Infrastruktur – eine Entwicklung, die auf dem Mobile World Congress 2026 an vielen Demonstrationen deutlich sichtbar wird.

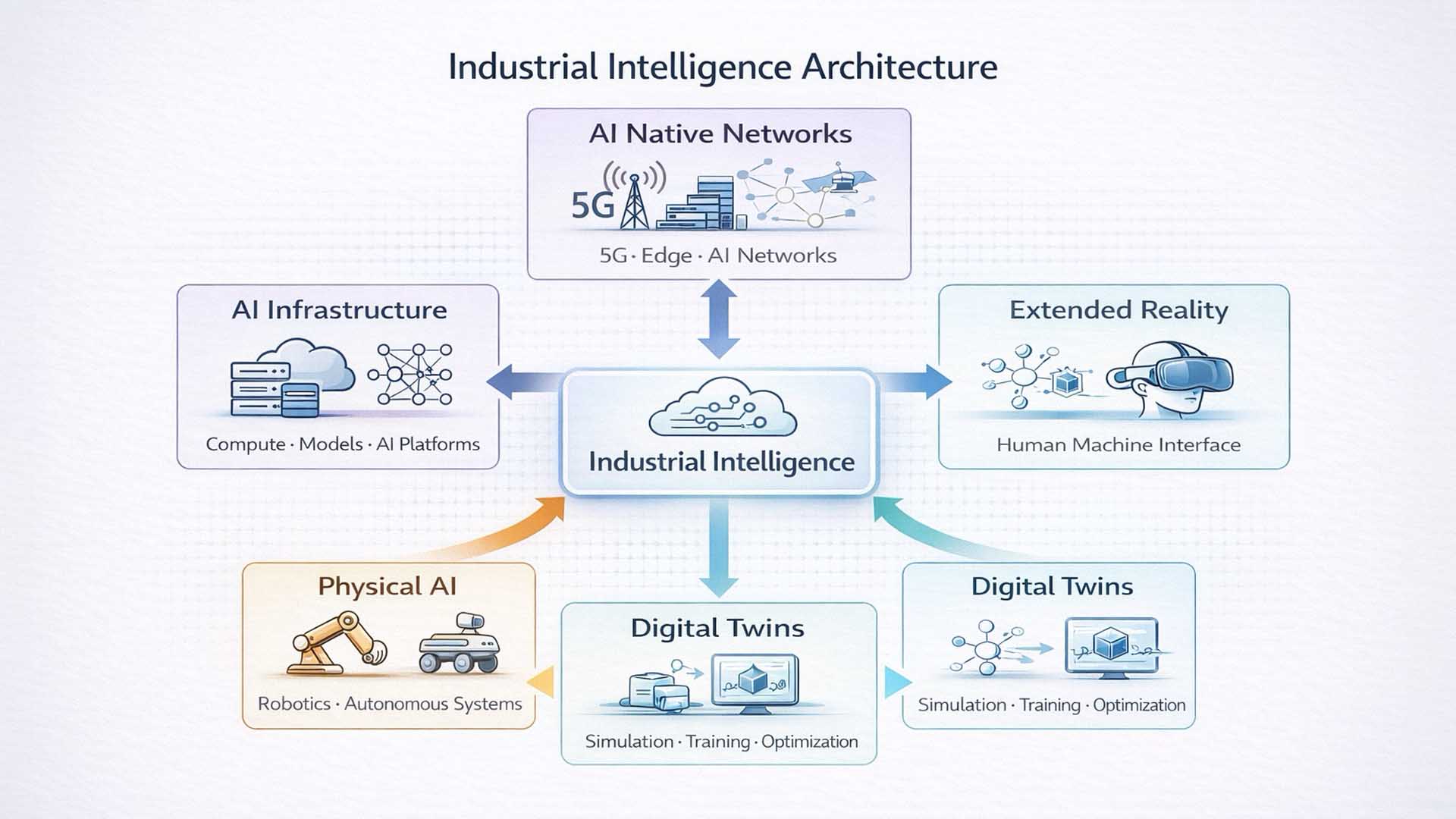

Die Architektur industrieller Intelligenz

Der Mobile World Congress 2026 zeigt nicht nur einzelne technologische Innovationen, sondern eine neue systemische Architektur. Künstliche Intelligenz entwickelt sich zunehmend von einer isolierten Softwarefunktion zu einer Infrastruktur, die physische Systeme, Netzwerke und digitale Modelle miteinander verbindet.

Die zentrale Idee lässt sich als industrielle Intelligenz beschreiben. Dabei handelt es sich um ein Zusammenspiel verschiedener technologischer Ebenen, die gemeinsam neue Formen von Automatisierung, Simulation und Zusammenarbeit ermöglichen.

- AI Native Networks stellen die Kommunikationsinfrastruktur bereit

- AI Infrastructure liefert Rechenleistung und Modelle

- Physical AI verbindet künstliche Intelligenz mit realen Maschinen

- Digital Twins ermöglichen Simulation und kontinuierliches Training

- Extended Reality schafft neue Schnittstellen zwischen Mensch und System

Industrial Intelligence Architecture – Technological convergence observed at Mobile World Congress 2026

Visualisierung: XR Stager Research / Visoric GmbH

Im Zentrum dieser Architektur steht die industrielle Intelligenz selbst. Sie entsteht aus dem Zusammenspiel mehrerer technologischer Entwicklungen, die auf dem Mobile World Congress an vielen Ständen sichtbar werden.

Die Grundlage bilden AI Native Networks. Moderne Mobilfunknetze entwickeln sich zunehmend zu intelligenten Plattformen, die Daten, Rechenleistung und Anwendungen dynamisch miteinander verbinden. Technologien wie 5G, Edge Computing und zukünftige 6G-Konzepte schaffen die Infrastruktur für diese verteilten Systeme.

Darauf aufbauend entsteht eine neue Generation von AI-Infrastrukturen. Leistungsfähige Rechenzentren, spezialisierte Chips und skalierbare Modelle ermöglichen es, große Datenmengen zu analysieren und komplexe Systeme zu steuern.

Mit Physical AI verlässt künstliche Intelligenz schließlich die reine Softwareebene. Roboter, autonome Maschinen und intelligente Geräte können ihre Umgebung wahrnehmen, Entscheidungen treffen und physische Aufgaben übernehmen.

Digitale Zwillinge bilden eine weitere zentrale Ebene dieser Architektur. Sie erlauben es, reale Systeme virtuell abzubilden, Simulationen durchzuführen und Modelle kontinuierlich zu verbessern. Maschinen, Produktionsanlagen oder ganze Infrastrukturen lassen sich dadurch präziser planen und optimieren.

Die Schnittstelle zwischen Mensch und diesen komplexen Systemen bildet schließlich Extended Reality. Räumliche Interfaces ermöglichen es, digitale Informationen direkt im Kontext realer Umgebungen darzustellen und mit ihnen zu interagieren.

Gemeinsam bilden diese Technologien die Grundlage für eine neue Generation intelligenter industrieller Systeme. Der Mobile World Congress 2026 macht deutlich, dass sich diese Architektur zunehmend aus einzelnen Innovationen herauskristallisiert.

Video Eindrücke vom Mobile World Congress 2026

Der Mobile World Congress in Barcelona gehört zu den wichtigsten Treffpunkten der internationalen Technologiebranche. Unternehmen aus den Bereichen Telekommunikation, künstliche Intelligenz, Robotik und Extended Reality präsentieren hier ihre neuesten Entwicklungen und geben Einblicke in kommende industrielle Anwendungen.

Die Messe zeigt eindrucksvoll, wie stark sich die technologische Landschaft derzeit verändert. Intelligente Netze, Edge-Computing, digitale Zwillinge und Physical AI wachsen zunehmend zu einer gemeinsamen Infrastruktur zusammen. Systeme werden nicht nur leistungsfähiger, sondern auch stärker miteinander vernetzt.

Was in Präsentationen oft abstrakt klingt, wird auf der Messe unmittelbar erlebbar. Roboter demonstrieren lernfähige Systeme, neue XR-Interfaces ermöglichen räumliche Interaktion mit Daten, und moderne Netzarchitekturen zeigen, wie Rechenleistung künftig näher an reale Prozesse heranrückt.

Das folgende Video zeigt persönliche Eindrücke direkt vom Messegelände. Die Aufnahmen vermitteln einen Eindruck der Atmosphäre, der Technologien und der internationalen Vielfalt dieser Veranstaltung.

Impressionen vom Mobile World Congress 2026 in Barcelona

Videoaufnahmen: © Ulrich Buckenlei | XR Stager Newsroom

Die Eindrücke zeigen, dass viele Entwicklungen, die lange als Zukunftsszenarien galten, inzwischen konkrete Formen annehmen. Netzwerke werden intelligenter, Maschinen autonomer und digitale Modelle präziser.

Der Mobile World Congress macht damit sichtbar, dass sich derzeit eine neue technologische Infrastruktur herausbildet. Sie verbindet Kommunikationsnetze, künstliche Intelligenz, physische Systeme und immersive Schnittstellen zu einer zunehmend integrierten digitalen Realität.

Im folgenden Abschnitt wird diese Entwicklung noch einmal zusammengeführt und in ihren industriellen Kontext eingeordnet.

Vom Messe Signal zur Unternehmensentscheidung

Der Mobile World Congress 2026 zeigt ein klares Muster. Künstliche Intelligenz wird zur Infrastruktur. Netze entwickeln sich zu intelligenten Plattformen. Physical AI verlagert KI in reale Maschinen. Digitale Zwillinge werden zur Trainings und Optimierungsumgebung. Und Extended Reality wird zur Schnittstelle, über die Menschen mit komplexen Systemen arbeiten.

Für Unternehmen entsteht daraus eine neue Art von Entscheidungsdruck. Die Frage ist nicht, ob diese Technologien kommen. Die Frage ist, welche dieser Bausteine für das eigene Geschäft relevant sind, wie sie zusammenspielen sollen und wie man sie ohne Showeffekt in belastbare Prozesse überführt.

Viele Organisationen scheitern nicht an der Technologie, sondern an der Einordnung. Welche Use Cases sind realistisch. Welche Daten und Systeme werden benötigt. Wie sieht eine Zielarchitektur aus. Wie werden Sicherheit, Governance und Verantwortlichkeiten geregelt. Und wie wird aus einer Messe Idee ein skalierbarer Betrieb.

Genau an dieser Schnittstelle arbeitet das Visoric Expertenteam in München. Wir unterstützen Unternehmen dabei, die relevanten Signale von Veranstaltungen wie dem Mobile World Congress strukturiert zu übersetzen. In Strategien, Architekturkonzepte und umsetzbare Roadmaps, die in der Organisation funktionieren.

Das Visoric Expertenteam aus München begleitet Unternehmen von der Messe Einordnung bis zur umsetzbaren Transformations Roadmap

Quelle: VISORIC GmbH | München

- MWC Trend Analyse → Einordnung der relevanten Entwicklungen für Ihre Branche und Ihr Geschäftsmodell

- Technologie Gutachten → Bewertung, ob AI, XR, Digital Twins oder neue Plattformen zu Ihren Zielen passen

- Use Case Design → Identifikation der Anwendungsfälle mit messbarem Nutzen und klaren Anforderungen

- Zielarchitektur → Konzeption von End to End Systemen über Netz, Edge, Cloud, Daten und Interfaces

- Pilot und Proof of Concept → schnelle Validierung der technischen und wirtschaftlichen Machbarkeit

- Workshops und Change Enablement → Entscheidungsfähigkeit schaffen und Umsetzung im Unternehmen verankern

Wenn Sie aus den Eindrücken des Mobile World Congress konkrete Schritte ableiten möchten, lohnt sich ein strukturiertes Gespräch. Gemeinsam klären wir, welche Technologie Bausteine für Ihr Unternehmen wirklich relevant sind und wie daraus eine umsetzbare Roadmap entsteht.

Kontaktpersonen:

Ulrich Buckenlei (Kreativdirektor)

Mobil: +49 152 53532871

E-Mail: ulrich.buckenlei@visoric.com

Nataliya Daniltseva (Projektleiterin)

Mobil: + 49 176 72805705

E-Mail: nataliya.daniltseva@visoric.com

Adresse:

VISORIC GmbH

Bayerstraße 13

D-80335 München